Approche GEO : cinq ajustements EdgeSEO pour maîtriser les moteurs de réponses

Contenu réalisé avec la contribution technique de Fasterize Alors que les environnements techniques évoluent rapidement, les équipes SEO doivent gagner …

Sommaire

- 1Fichiers LLM et recommandations pratiques

- 2Le **Markdown** pour alléger et structurer le contenu destiné aux agents IA

- 3FAQ dynamiques et format Question/Réponse pour les systèmes RAG

- 4Performance web et budget de crawl IA : l’effet de la latence

- 5Rendu dynamique versus cloaking : adapter la livraison sans tromper

- 6Conclusion et checklist opérationnelle pour les équipes SEO

- 7Articles connexes

Contenu réalisé avec la contribution technique de Fasterize

Alors que les environnements techniques évoluent rapidement, les équipes SEO doivent gagner en réactivité : tester et déployer des optimisations ne peut plus se dérouler uniquement sur des cycles annuels. Il devient essentiel de pouvoir intervenir en quasi‑temps réel pour maintenir et améliorer la visibilité.

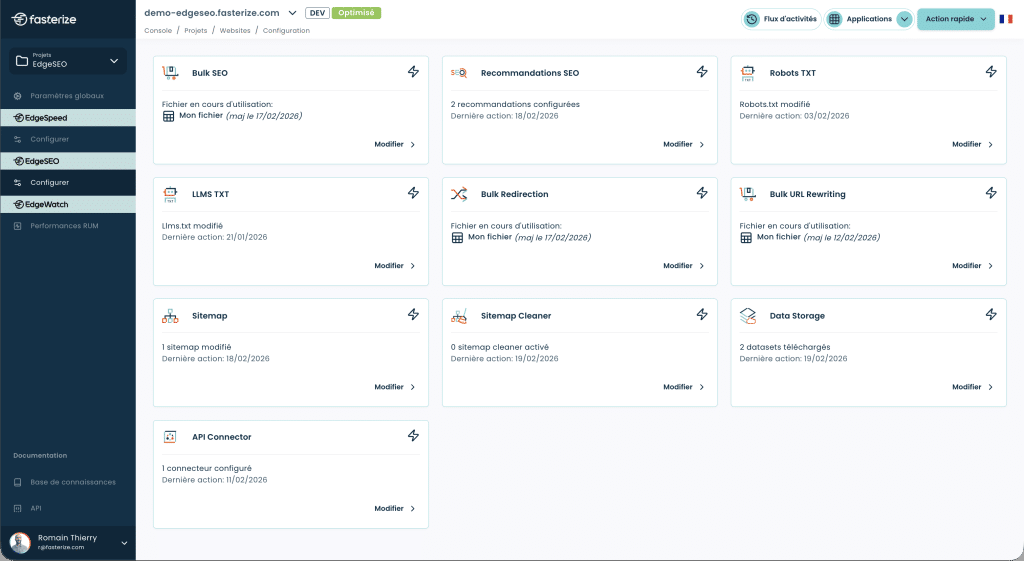

Des solutions côté edge et de transformation dynamique permettent aujourd’hui aux équipes SEO de piloter des expérimentations techniques sans mobiliser en permanence les ressources de développement. Cette aptitude à itérer rapidement prend d’autant plus d’importance que les moteurs de réponse fondés sur l’IA (ChatGPT, Perplexity, Gemini…) modifient les modes d’accès à l’information en ligne.

Fichiers LLM et recommandations pratiques

Le fichier robots.txt a longtemps servi de référence universelle pour définir l’accès des crawlers aux ressources d’un site. Avec l’émergence d’agents d’IA spécialisés, une nouvelle convention a commencé à apparaître : les fichiers /llms.txt et /llms-full.txt, conçus pour expliciter des règles destinées aux modèles de langage. En théorie, ces fichiers visent à préciser quelles parties d’un site peuvent être consultées par les LLMs, quelles données peuvent être réutilisées et sous quelles conditions les contenus peuvent être exploités.

Techniquement, il est possible de délivrer ces fichiers de manière conditionnelle selon l’User‑Agent détecté afin d’appliquer des règles spécifiques à chaque type d’agent. Des architectures de type edge peuvent servir ces fichiers de façon dynamique, évitant ainsi la multiplication de versions statiques et permettant d’adapter rapidement les directives à l’évolution des pratiques d’indexation des différents modèles.

Remarque importante : les retours d’expérience montrent que les LLMs ne respectent pas tous ces fichiers de la même façon. Google a précisé publiquement qu’il ne s’appuyait pas sur llms.txt, et le comportement des autres modèles varie selon le contexte d’utilisation. En conséquence, conserver un robots.txt bien configuré reste aujourd’hui la meilleure pratique largement reconnue pour orienter l’exploration des crawlers classiques.

Il faut aussi garder en tête qu’un fichier déclaratif ne constitue pas une garantie légale ou technique contre l’inclusion de contenus dans des jeux de données tiers (par exemple via des collectes publiques comme Common Crawl). La mise en place d’un llms.txt doit donc être vue comme une démarche expérimentale et préventive : elle peut envoyer des signaux utiles et contribuer à la traçabilité des intentions éditoriales, mais elle n’assure pas un contrôle absolu.

En pratique, l’approche recommandée consiste à documenter vos choix, à déployer des versions tests et à monitorer les effets : observer si des modèles prennent en compte les directives, vérifier les logs d’accès selon les User‑Agents, et ajuster en fonction des constats. Il s’agit d’une stratégie de test & learn qui prépare votre site à des évolutions futures sans prétendre garantir un résultat immédiat.

Le Markdown pour alléger et structurer le contenu destiné aux agents IA

Le Markdown s’impose de plus en plus comme un format privilégié pour l’alimentation des LLMs : plus succinct et moins verbeux que du HTML intégral, il réduit le « bruit » technique (headers, menus, scripts) et facilite le parsing des informations essentielles. Des outils d’extraction et de conversion (par exemple des solutions comme Crawl4AI ou Firecrawl) sont massivement utilisés pour transformer du HTML en Markdown, et certains modèles (comme ReaderLM‑v2) sont entraînés spécifiquement pour traiter ce format optimisé.

Le principe opérationnel est simple : pour certains agents identifiés, il est pertinent de convertir le HTML en Markdown à la volée afin de leur fournir une version épurée et structurée du contenu. Cette conversion retire les éléments non pertinents et présente au LLM un flux de texte dense et économiquement consommable en tokens. Sur des pages très lourdes (par exemple certaines pages produit contenant beaucoup de balises et de scripts), la transformation peut réduire drastiquement le nombre de tokens nécessaires — dans certains cas, la diminution atteint l’ordre de grandeur de 99 % pour le cœur du contenu utile.

Une implémentation côté edge permet d’appliquer cette conversion uniquement lorsque l’User‑Agent correspond à un agent IA ciblé, sans dupliquer le contenu éditorial. Ainsi, la page affichée aux visiteurs humains reste inchangée tandis que la version remise aux agents est allégée et structurée en Markdown. Ce mécanisme évite les risques de désynchronisation entre versions et limite les problématiques de duplication de contenu classiques.

Cependant, plusieurs points de vigilance doivent être pris en compte :

- Assurer l’équivalence d’information : la version Markdown doit refléter fidèlement le contenu publié pour les utilisateurs, sans ajouts ni omissions significatives.

- Maintenir les éléments structurants : conserver ou dériver les données issues de balises structurées (schema.org) afin d’aider les systèmes à comprendre le contexte sémantique.

- Gérer la mise en cache et la durée de validité : la conversion dynamique peut compliquer la stratégie de cache ; il est utile de définir des règles claires pour la cache côté edge.

- Documenter les transformations : garder un historique des règles qui convertissent le HTML en Markdown pour faciliter la traçabilité et les audits.

En résumé, l’usage du Markdown pour cibler les agents IA est une piste technique efficace pour réduire le coût en tokens et améliorer la qualité du signal envoyé aux modèles, à condition d’être mise en œuvre avec rigueur et transparence.

FAQ dynamiques et format Question/Réponse pour les systèmes RAG

Le format Question/Réponse (FAQ) s’aligne naturellement avec les architectures de type RAG (Retrieval‑Augmented Generation) couramment utilisées pour alimenter les modèles génératifs. Dans un système RAG, des fragments de contenu pertinents sont récupérés pour constituer le contexte d’entrée du modèle ; une structure Q/R facilite l’identification et l’extraction de la bonne information.

Sur des pages stratégiques (pages catégories, fiches produit importantes, pages support), il peut être pertinent d’ajouter de manière dynamique des blocs FAQ conçus pour répondre à des intentions de « zéro‑clic » — c’est‑à‑dire des questions dont la réponse complète peut être fournie directement dans le bloc sans renvoi systématique vers une autre page. L’injection de ces contenus peut se faire côté serveur pour garantir leur présence dans le HTML initial, ce qui augmente les chances qu’ils soient perçus et repris par les agents IA.

Quelques principes à respecter :

- Ne pas gonfler artificiellement les pages : chaque FAQ doit répondre à une intention réelle identifiée par l’analyse des requêtes et du comportement utilisateur.

- Privilégier la concision et la précision : les réponses doivent être claires, sourcées si nécessaire, et directement exploitables par un modèle qui ne dispose que d’un budget de tokens limité.

- Maintenir la cohérence éditoriale : la FAQ injectée doit compléter et synthétiser l’information présente sur la page, sans introduire d’incohérences.

- Assurer la fraîcheur : prévoir des mécanismes de mise à jour pour les réponses susceptibles d’évoluer (tarifs, disponibilité, réglementation, etc.).

Un cas fréquent d’oubli dans l’indexation par les modèles IA concerne les contenus embarqués via iFrames ou chargés entièrement par JavaScript côté client, comme certains widgets d’avis clients. Ces éléments sont souvent invisibles aux crawlers qui ne rendent pas l’exécution JavaScript. Pour pallier cela, il est recommandé de récupérer via API les avis ou contenus essentiels et de les injecter directement dans le HTML côté serveur, afin qu’ils soient présents dans le DOM initial analysé par les LLMs.

Cette approche renforce la dimension E‑E‑A‑T (Experience, Expertise, Authoritativeness, Trustworthiness) du site : les avis et preuves sociales deviennent directement exploitables par les systèmes de recommandation et augmentent la crédibilité du contenu dans les réponses générées. En revanche, il faut veiller à la conformité aux règles de confidentialité et à la pertinence des données affichées (ne pas afficher d’informations sensibles ou non autorisées).

Performance web et budget de crawl IA : l’effet de la latence

Des analyses menées sur des corpus de sites cités par des outils IA montrent une corrélation nette entre la qualité technique d’un site et sa propension à être intégré dans les réponses génératives. Les indicateurs classiques des Core Web Vitals (notamment LCP, CLS) restent déterminants, d’autant plus que la vitesse et la taille du HTML influencent directement la capacité des LLM‑bots à récupérer et parser les pages.

Une étude sectorielle met en avant des corrélations mesurables :

- Les pages avec un CLS ≤ 0,1 présentent un taux d’inclusion dans les résumés génératifs supérieur d’environ 30 % par rapport aux pages plus instables visuellement.

- Les URLs affichant un LCP ≤ 2,5 s ont environ 1,47 fois plus de chances d’être citées que les pages plus lentes.

- Les crawlers abandonnent fréquemment les pages dont le HTML dépasse 1 Mo, ce qui souligne l’importance d’un balisage léger.

- Un TTFB (Time to First Byte) inférieur à 200 ms corrèle avec une augmentation substantielle de la densité de citations, particulièrement lorsque la stratégie de cache est robuste.

Ces chiffres signifient une chose simple : un fort niveau de latence réduit mécaniquement le nombre de pages réellement exploitables par les agents IA. Ceux‑ci privilégient des sources accessibles rapidement et lisibles sans surcharge de contenu superflu.

Pour améliorer ces métriques, plusieurs leviers techniques peuvent être actionnés :

- Optimisation des images (format moderne, compression adaptative, lazy‑loading lorsque pertinent).

- Réduction du poids du HTML : minification, suppression des blocs inutiles, élimination du code et des commentaires superflus.

- Optimisation CSS/JS : découpage critique du CSS, suppression des scripts non essentiels en head, report d’exécution (defer/async) lorsque possible.

- Mise en place d’un CDN et d’une stratégie de cache edge pour diminuer le TTFB et stabiliser les temps de réponse.

- Audit régulier des plugins et des intégrations tierces qui peuvent alourdir le rendu initial.

Des solutions orientées performance côté edge peuvent réduire significativement le TTFB et améliorer la stabilité des temps de réponse, rendant davantage d’URLs exploitables par les crawlers IA. L’effort technique consenti se traduit souvent par un gain direct d’audience dans les contextes où les modèles génèrent des réponses en s’appuyant sur des sources identifiables et rapides à charger. Pour compléter ces points, voir l’étude publiée par Salt Agency qui détaille des corrélations techniques observées entre webperf et visibilité IA.

Rendu dynamique versus cloaking : adapter la livraison sans tromper

Une difficulté récurrente est la suivante : un site peut offrir une excellente expérience utilisateur, mais rester méconnu des LLMs parce que son contenu principal est rendu via du JavaScript que certains crawlers ne peuvent pas exécuter. Cela pose la question de la façon d’exposer les mêmes informations aux agents IA sans pratiquer de cloaking (dissimulation de contenu).

La distinction clé réside dans l’intention et la similarité du contenu : le dynamic rendering n’est pas perçu comme du cloaking par les moteurs dès lors que ce qui est servi aux crawlers correspond fidèlement à l’information disponible pour les utilisateurs. Autrement dit, il est acceptable d’adapter le format technique (par exemple livrer une version texte riche pour les bots et une version interactive pour les humains) à condition que le contenu informatif soit équivalent.

Quelques règles d’or pour rester conforme :

- Ne pas introduire d’information différente entre la version utilisateur et la version servie aux agents : pas de textes cachés, pas d’ajouts invisibles.

- Veiller à la transparence : conserver des logs d’accès et de détection d’User‑Agent pour pouvoir justifier des traitements en cas d’audit.

- Préférer le Server‑Side Rendering (SSR) quand cela est possible : Google recommande depuis 2022 d’adopter le SSR comme solution long terme pour garantir l’indexabilité et la cohérence des contenus.

- Lorsque le rendu dynamique est employé, documenter la logique d’adaptation et s’assurer que toute version servie contient une représentation complète de l’information visible pour un utilisateur standard.

Dans le contexte actuel (2026), de nombreux agents IA ne parviennent pas encore à exécuter l’ensemble du JavaScript front‑end. Adapter la livraison en rendant côté serveur les contenus critiques (par exemple en réinjectant des données chargées via API dans le HTML initial) est donc une solution pragmatique pour garantir la lisibilité par les modèles. Cette stratégie doit toutefois être appliquée avec rigueur pour éviter toute dérive vers un cloaking effectif.

Conclusion et checklist opérationnelle pour les équipes SEO

La transformation des parcours de recherche via des agents IA impose de repenser certains aspects techniques du SEO : formats d’export, structure du contenu, performance et mode de rendu. Voici une synthèse des bonnes pratiques à prioriser :

- Documenter et tester : déployer des llms.txt en mode expérimental, monitorer les impacts et conserver des traces des tests.

- Alléger pour l’IA : proposer une version Markdown pour les agents identifiés afin de réduire le coût en tokens et améliorer la qualité du signal.

- Structurer l’information : injecter des blocs FAQ pertinents et s’assurer que les données essentielles (avis, spécifications, prix) sont présentes dans le HTML initial.

- Optimiser la webperf : viser des seuils raisonnables pour LCP, CLS et TTFB, réduire la taille du HTML et privilégier le cache edge.

- Maintenir la conformité : éviter toute divergence informationnelle entre versions et privilégier le SSR quand c’est possible.

- Surveiller et ajuster : analyser les logs, suivre l’évolution des User‑Agents, et adapter les règles en fonction des comportements observés.

En adoptant une démarche itérative, documentée et technique — tout en respectant les principes d’équivalence d’information — les équipes peuvent améliorer la capacité de leurs sites à être exploités par les systèmes de génération de réponses, sans compromettre l’expérience utilisateur ni la conformité avec les moteurs de recherche.

Ressources complémentaires : documentation technique sur les formats et les bonnes pratiques, études de cas sur la performance et l’indexation, ainsi que retours d’expérience disponibles auprès de fournisseurs de solutions edge et de spécialistes du technical SEO.

Articles similaires

seo

seoRéférencement local et géolocalisation : HubSpot pour les entreprises qui veulent s’imposer sur leur territoire

seo

seoMise à jour des liens du mode IA de Google, données sur la part de clics et propagation de ChatGPT — actualité SEO

seo

seo