Pendant longtemps, la pratique du référencement s’appuyait sur une vision binaire et stable : d’un côté l’optimisation pour les robots d’indexation, de l’autre la rédaction pour des internautes humains. Cette séparation nette appartient désormais au passé.

Dans l’environnement numérique actuel, une nouvelle génération d’acteurs redistribue les cartes de la visibilité en ligne. Des systèmes conversationnels et automatisés comme agents d’IA (ChatGPT, Perplexity, Claude, Gemini, etc.) ne se contentent plus de traiter des requêtes : ils explorent des sources, synthétisent des informations, choisissent les références à citer et orientent, de manière croissante, les flux de trafic.

Pour qui doute encore de l’ampleur du phénomène, il est utile de revenir sur le concept du ZMOT (Zero Moment of Truth) élaboré par Google il y a plus d’une décennie : avant d’acheter, les consommateurs recherchent, comparent, lisent des avis, collectent des signaux sociaux et, aujourd’hui, sollicitent souvent un assistant d’IA pour valider leurs choix.

Un paradigme renouvelé

Le paysage digital est en pleine recomposition : là où jadis quelques moteurs et canaux principaux suffisaient à expliquer le trafic, s’impose désormais une architecture multi-acteurs. Google reste un point d’ancrage majeur grâce à ses algorithmes de classement ; les humains continuent de jouer le rôle d’amplificateurs via le partage social ; mais, progressivement, les agents d’IA s’affirment comme un véritable moteur autonome de trafic.

Ces agents analysent des contenus, appliquent des critères propres, priorisent des ressources et redirigent des utilisateurs vers des sources qu’ils jugent pertinentes. Ce basculement impose une redéfinition profonde des méthodes de production et d’optimisation du contenu.

La stratégie éditoriale doit désormais intégrer non seulement les attentes humaines et les contraintes techniques des moteurs classiques, mais aussi les modes de consommation propres aux systèmes conversationnels et aux workflows automatisés. Dans les sections suivantes je développe des pistes concrètes et des retours d’expérience pour aider à adapter les sites à cette nouvelle donne.

Le concept de Agentic SEO

Le terme Agentic SEO désigne une approche de création de contenu structurée et dynamique, pensée pour être pertinente tant pour Google que pour les agents d’IA conversationnels. L’idée centrale est d’anticiper les processus de lecture, de récupération et de génération d’information opérés par ces systèmes.

Le SEO agentique vise à produire des ressources modulaires, balisées sémantiquement et facilement exploitables par des modèles de langage et des agents conversationnels.

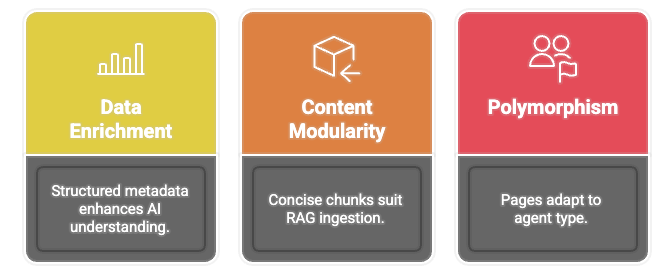

Trois piliers structurent cette démarche :

1. Enrichissement des données : l’usage de formats structurés (Schema.org, microformats, balises sémantiques) facilite la compréhension et l’extraction d’information par les modèles de langage. Lorsque les contenus sont solidement « ancrés » par des données structurées, ils deviennent plus accessibles et fiables pour les agents d’IA.

2. Modularité du contenu : des réponses courtes, découplées en blocs réutilisables, conviennent parfaitement aux processus de RAG (Retrieval-Augmented Generation) et aux pipelines d’ingestion des agents. Concevoir des unités autonomes de contenu permet de recomposer des réponses adaptées à différents contextes.

3. Polymorphisme : une même page peut proposer des variantes optimisées selon le type d’agent qui la consulte. Un agent dédié au shopping n’a pas les mêmes attentes qu’un agent médical : le contenu doit donc pouvoir prendre différentes formes (angles prix/performance/sécurité, niveaux de détail, formats multimédias).

Si un site web n’est pas préparé pour dialoguer avec des agents d’IA, il prend un retard stratégique important. A contrario, un site déjà optimisé pour le référencement traditionnel dispose d’une base solide pour évoluer vers ces nouvelles pratiques.

Les bases : SEO génératif et Edge SEO

Pour comprendre la transition vers le SEO agentique, il est utile d’examiner deux mouvements qui ont préparé le terrain : le SEO génératif et l’Edge SEO.

SEO génératif

Le SEO génératif désigne l’utilisation de modèles de langage pour produire des contenus volumineux et pertinents à grande échelle. Plutôt que des techniques anciennes comme le spinning, les technologies actuelles permettent de co-créer des textes de qualité, adaptés sémantiquement aux requêtes utilisateurs et cohérents sur le plan éditorial.

À mesure que les réseaux sociaux et les plateformes intègrent davantage de contenu produit ou assisté par l’IA, la frontière entre production humaine et production automatique s’estompe. L’enjeu n’est plus de remplacer la créativité humaine, mais d’orchestrer la synergie entre expertise humaine, supervision éditoriale et capacités d’automatisation des modèles.

Edge SEO

L’Edge SEO exploite des points de déploiement aux marges du réseau (CDN, proxies, serveurs edge) pour réduire la latence des mises en ligne et permettre des expérimentations à grande échelle sur la structure et la présentation des pages. En opérant au niveau du CDN, on peut injecter, modifier ou personnaliser du contenu sans passer par des déploiements lourds côté back-end.

Ces deux approches se complètent naturellement : le SEO génératif alimente en variantes textuelles et sémantiques, tandis que l’Edge SEO permet de livrer ces variantes rapidement, à la demande et de façon ciblée. Pourtant, elles restent souvent statiques si les tests A/B traditionnels et le gel des contenus persistent après génération. La véritable avancée survient lorsque les systèmes deviennent dynamiques et adaptatifs en continu.

La rupture se produit lorsque les contenus deviennent vivants : testés, évalués et adaptés en temps réel en fonction des signaux des moteurs et du comportement des utilisateurs.

Agentic Edge SEO : contenus adaptatifs en temps réel

L’Edge SEO a déjà remis en cause l’idée d’une page figée. L’étape suivante consiste à rendre le contenu capable de se modifier en direct selon plusieurs variables critiques :

- La détection de l’intention utilisateur permet d’orienter instantanément le message — analyse comportementale et signaux de navigation guident l’ajustement du discours.

- La saisonnalité et l’évolution des résultats de recherche (SERP) modifient les priorités d’affichage : quand une tendance devient saillante sur une requête, le contenu s’aligne pour capitaliser sur cette actualité.

- Les optimisations techniques déclenchées par les signaux de performance (Core Web Vitals) assurent que l’expérience reste fluide et conforme aux attentes de temps de chargement et de stabilité.

Image from author, September 2025

Image from author, September 2025Illustrons avec un exemple concret : une page produit peut détecter, via l’analyse de tendances SERP, que les requêtes associées privilégient aujourd’hui les aspects « durabilité » ou « économie ». Le système adapte alors titres, métadonnées et visuels pour répondre rapidement à ces signaux et rester pertinent dans le fil des résultats.

Sur le plan technique, des connecteurs entre outils de performance (CDN, plateformes d’optimisation) et moteurs de génération d’IA permettent de déployer des workflows automatisés. Ces workflows alimentent des variantes alimentées par des modèles propriétaires ou open-source (LLM), et collectent des métriques en quasi-temps réel pour évaluer l’efficacité des variantes.

Un processus adaptatif typique suit ces étapes : génération de variantes → diffusion via la couche edge → collecte de signaux (CTR, positionnement, taux de conversion) → sélection et propagation de la version la plus performante. L’algorithme sélectionne la variante gagnante selon des critères combinés de visibilité (CTR), position dans les SERP et conversion.

Considérez une landing page dédiée aux « chaussures de course » existant sous sept axes distincts : prix, performance, confort, écologie, style, durabilité, innovation. Un système polymorphe met en avant, en temps réel, la version la plus pertinente au regard des signaux moteurs et du comportement utilisateur.

Trois usages concrets et immédiats

Ces concepts ne restent pas théoriques : plusieurs usages opérationnels sont déjà testés et déployés dans des secteurs stratégiques. Voici trois cas d’application représentatifs.

1. E‑commerce : pages produits auto‑évolutives

Dans le commerce en ligne, les pages produits peuvent se métamorphoser selon les tendances de recherche, les stocks disponibles et les préférences détectées chez les visiteurs. Plutôt que de multiplier manuellement des variantes, on met en place des blocs modulaires qui se combinent automatiquement pour maximiser la pertinence.

Exemple : une plateforme de location de véhicules avec des milliers de pages locales adapte le contenu selon la saison et l’audience locale. En été, la page « location voiture Nice » met en avant les cabriolets et des témoignages familiaux ; en hiver, le contenu pivote vers des véhicules 4×4 et des conseils pour la conduite en montagne.

La capacité à injecter dynamiquement promotions, stocks, évaluations utilisateurs ou sections locales permet de maintenir un contenu frais et aligné sur l’intention réelle du visiteur.

2. Médias : articles « vivants » et mise à jour automatique

Les rédactions peuvent déployer des articles vivants qui se mettent à jour automatiquement avec les derniers éléments factuels. Ces articles conservent une base rédigée par des journalistes, tandis que des composants alimentés par des flux (APIs, dépêches) rafraîchissent les segments factuels en temps réel.

Ce modèle réduit le risque d’obsolescence et améliore la valeur pratique pour le lecteur sans remplacer le travail éditorial humain, qui demeure central pour l’analyse et la mise en contexte.

3. Sites de promotions et coupons : pages commerciales réactives

Les portails de codes promo et offres commerciales deviennent plus performants lorsqu’ils intègrent, en direct, les annonces de partenaires, bannières contextuelles et compteurs temporels liés aux événements commerciaux (Prime Day, Black Friday, etc.).

Par exemple, trois semaines avant un événement majeur, les pages dédiées à une marque intègrent automatiquement des sections thématiques, ajustent les mots‑clés et mettent en avant les offres détectées via les APIs partenaires. Ces enrichissements ne nécessitent pas d’édition manuelle mais suivent des règles automatiques de contextualisation.

Vers une nouvelle ère du référencement

La direction à prendre pour le référencement consiste à publier des contenus dynamiques capables de s’adapter aux algorithmes et aux comportements qui évoluent en permanence. Cela implique une mutation des méthodologies : passer d’une logique de page statique à une logique de système adaptatif.

Conséquences pratiques :

- Les équipes doivent acquérir des compétences en orchestration de flux de données, en structuration sémantique (Schema.org, microformats) et en intégration avec des plateformes edge.

- La collaboration entre développeurs, spécialistes SEO et rédacteurs devient plus étroite : définir des modules réutilisables et des règles de personnalisation requiert une gouvernance éditoriale et technique commune.

- Les métriques prennent une place centrale : surveillance fine du CTR, des positions, des conversions et des signaux UX (notamment Core Web Vitals) pour alimenter les boucles d’optimisation.

Il est important de souligner que le SEO agentique ne se résume pas à une mode passagère : il représente une réponse nécessaire à la transformation du paysage informationnel. Les organisations qui savent combiner enrichissement structuré, modularité du contenu et adaptabilité polymorphe disposeront d’un avantage compétitif notable dans l’économie de l’attention.

Points de vigilance :

- Qualité et fiabilité : l’automatisation ne doit pas compromettre la véracité des informations ; les flux et modèles doivent être supervisés et audités.

- Respect des règles et éthique : la personnalisation et le ciblage doivent rester conformes aux réglementations (protection des données, transparence éditoriale) et aux guides qualité des moteurs.

- Mesure continue : le passage au mode adaptatif exige des pipelines de collecte et d’analyse des performances en continu pour éviter les dérives et identifier les meilleures variantes.

En pratique, l’évolution peut suivre un plan itératif : cartographier les pages prioritaires → structurer les données → découper le contenu en modules réutilisables → déployer des expériences edge → monitorer et automatiser la sélection des variantes gagnantes. À chaque étape, l’objectif est de réduire la friction entre la génération de contenu, sa delivery et son évaluation.

Ressources complémentaires :

Featured Image: Collagery/Shutterstock