TL;DR

- Search Console présente des limites importantes en matière de stockage, de données anonymisées ou incomplètes, et de quotas API.

- Vous pouvez contourner une grande partie de ces restrictions en multipliant les propriétés au niveau des sous-dossiers afin de tirer davantage parti de GSC.

- Un compte Search Console peut contenir jusqu’à 1 000 propriétés. Ne vous contentez pas d’une seule propriété au niveau du domaine.

- Cela ouvre la porte à des analyses d’**indexation**, de requêtes et de pages beaucoup plus riches — et tout cela gratuitement, notamment en profitant du plafond de 2 000 URL par propriété via l’**API** d’indexation.

Image Credit: Harry Clarkson-Bennett

Image Credit: Harry Clarkson-BennettCe guide s’adresse principalement aux sites de type entreprise : sites volumineux avec une arborescence profonde et une longue histoire de contenus publiés. Cela dit, la méthode n’est pas réservée aux éditeurs : les sites e-commerce et autres gros domaines tireront bénéfice des mêmes principes.

J’ai une affinité particulière pour les sites larges et complexes. Ils ont souvent le plus à gagner de solutions structurelles simples.

Qu’est-ce qu’une propriété dans Search Console ?

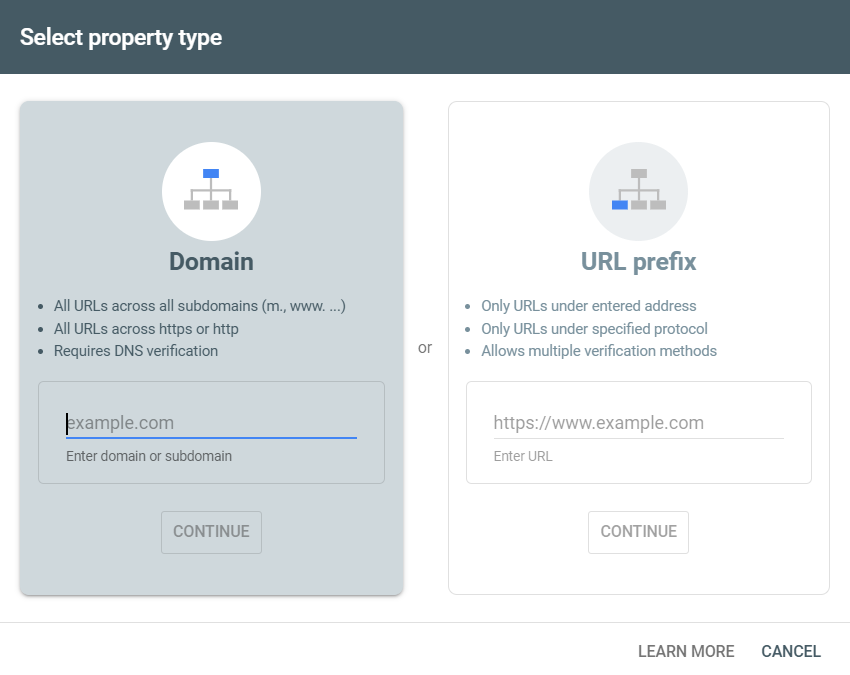

Une propriété Search Console correspond à une variante d’un site — domaine, sous-domaine ou préfixe d’URL — que vous prouvez posséder.

Vous pouvez déclarer des propriétés au niveau du domaine ou au préfixe d’URL (Image Credit: Harry Clarkson-Bennett)

Vous pouvez déclarer des propriétés au niveau du domaine ou au préfixe d’URL (Image Credit: Harry Clarkson-Bennett)Même si la création d’une propriété au niveau du domaine vous donne accès aux éléments essentiels de GSC — données de clics et d’impressions, rapports d’**indexation**, et le rapport des crawl stats (disponible uniquement pour les propriétés de domaine) — l’utilisation d’une unique propriété vous expose à des contraintes notables :

- Limite de 1 000 lignes pour les données de requêtes et de pages.

- Quota de 2 000 URL par jour via l’**API** d’indexation pour l’analyse au niveau des URL.

- Données de mots-clés échantillonnées et partiellement masquées pour des raisons de confidentialité.

- Données manquantes — dans certains cas, plus de 70 % des résultats sont absents.

- Historique limité à 16 mois.

Si certaines de ces limites (historique et échantillonnage) se traitent idéalement via une connexion à BigQuery, il est possible d’améliorer considérablement la valeur de Search Console en multipliant les propriétés.

Google propose plusieurs méthodes de vérification — DNS, balise HTML, fichier à uploader, ou code de suivi Google Analytics. Une fois la propriété de domaine validée, vous pouvez ajouter des propriétés « enfant » : sous-domaines et sous-dossiers.

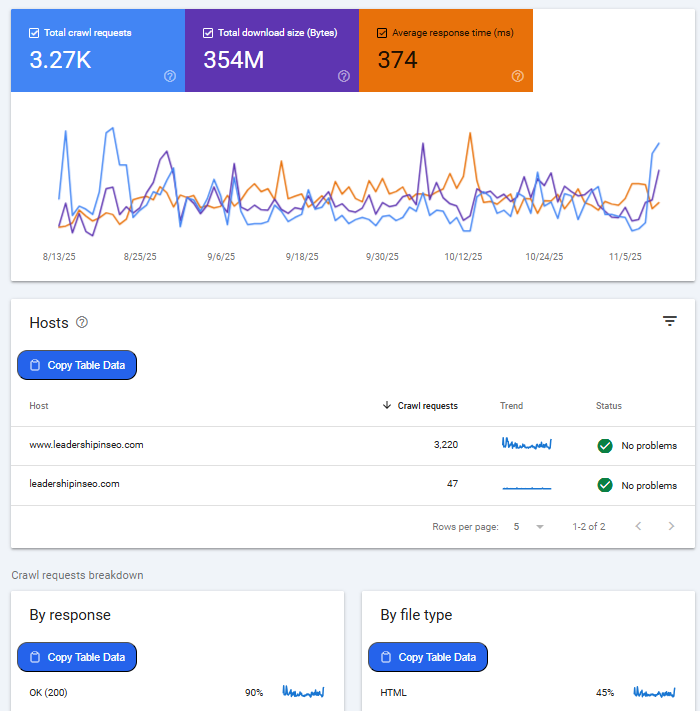

Le rapport des crawl stats peut être extrêmement utile pour les très grands sites (Image Credit: Harry Clarkson-Bennett)

Le rapport des crawl stats peut être extrêmement utile pour les très grands sites (Image Credit: Harry Clarkson-Bennett)Le rapport des crawl stats est particulièrement précieux pour diagnostiquer des incidents : explosion d’URLs de paramètres, comportement inattendu d’un sous-domaine, etc. Sur de gros sites multiservices, ce type de diagnostic évite bien des surprises.

En segmentant les données par hôte, type de fichier et code de réponse, vous pouvez identifier rapidement la source d’un problème et agir sur la gestion du crawl budget ou sur des pratiques de liens internes qui génèrent trop d’URLs.

Parfois, un avertissement verbal suffit ; parfois il faut être plus ferme. Mais mieux vaut pouvoir retrouver la source du problème.

Les sous-domaines sont souvent traités comme des entités séparées avec leur propre allocation de crawl budget. Néanmoins, comme l’a indiqué John Mueller, Google peut parfois regrouper des sous-domaines pour l’allocation du budget de crawl.

D’après Gary Illyes, l’**allocation de crawl** est fréquemment décidée par nom d’hôte ; ainsi un sous-domaine pourrait recevoir son propre budget si le nom d’hôte est distinct.

Comment repérer les bonnes propriétés à créer ?

En tant que spécialiste SEO, vous devez connaître la structure du site mieux que quiconque. Sur des sites de taille raisonnable, cette connaissance est souvent accessible directement via GSC. Pour les environnements complexes, commencez par crawler le site.

Utilisez des outils comme Screaming Frog, Sitebulb ou l’outil anciennement connu sous le nom de DeepCrawl pour dresser une cartographie précise. Identifiez ensuite les sous-dossiers prioritaires — ceux qui génèrent du chiffre d’affaires ou du trafic — et ajoutez-les comme propriétés dans Search Console.

Quelles alternatives à GSC existent ?

Avant d’aller plus loin, il est utile de citer quelques solutions externes qui suppriment ou atténuent certaines limites de Search Console.

SEO Stack

SEO Stack est une plateforme robuste qui élimine les plafonds de lignes et offre un système d’analyse proche d’un moteur MCP, facilitant l’exploration de tendances (par exemple : pages performantes en septembre année après année).

Le fondateur met l’accent sur le concept de query counting, une méthode intéressante pour mesurer l’évolution des performances : remonter significativement dans les top positions est positif ; perdre des positions et récupérer plus bas dans le classement est souvent un signal d’alerte.

SEO Gets

SEO Gets se positionne comme une alternative plus abordable. Comme SEO Stack, il supprime les limites classiques de GSC et facilite l’analyse de contenu à large échelle.

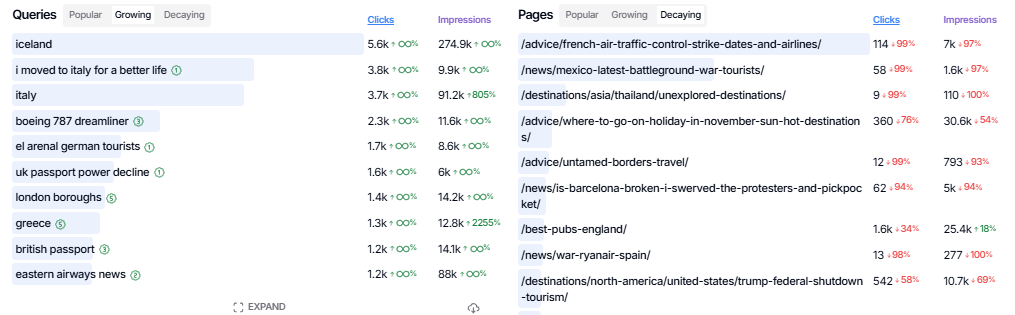

Visualisations des pages en croissance et en décroissance dans SEO Gets (Image Credit: Harry Clarkson-Bennett)

Visualisations des pages en croissance et en décroissance dans SEO Gets (Image Credit: Harry Clarkson-Bennett)Vous pouvez créer des groupes de mots-clés et de pages pour appliquer le query counting à des clusters de contenu et analyser clics et impressions de façon plus stratégique. La version gratuite reste l’une des plus généreuses du marché.

Indexing Insight

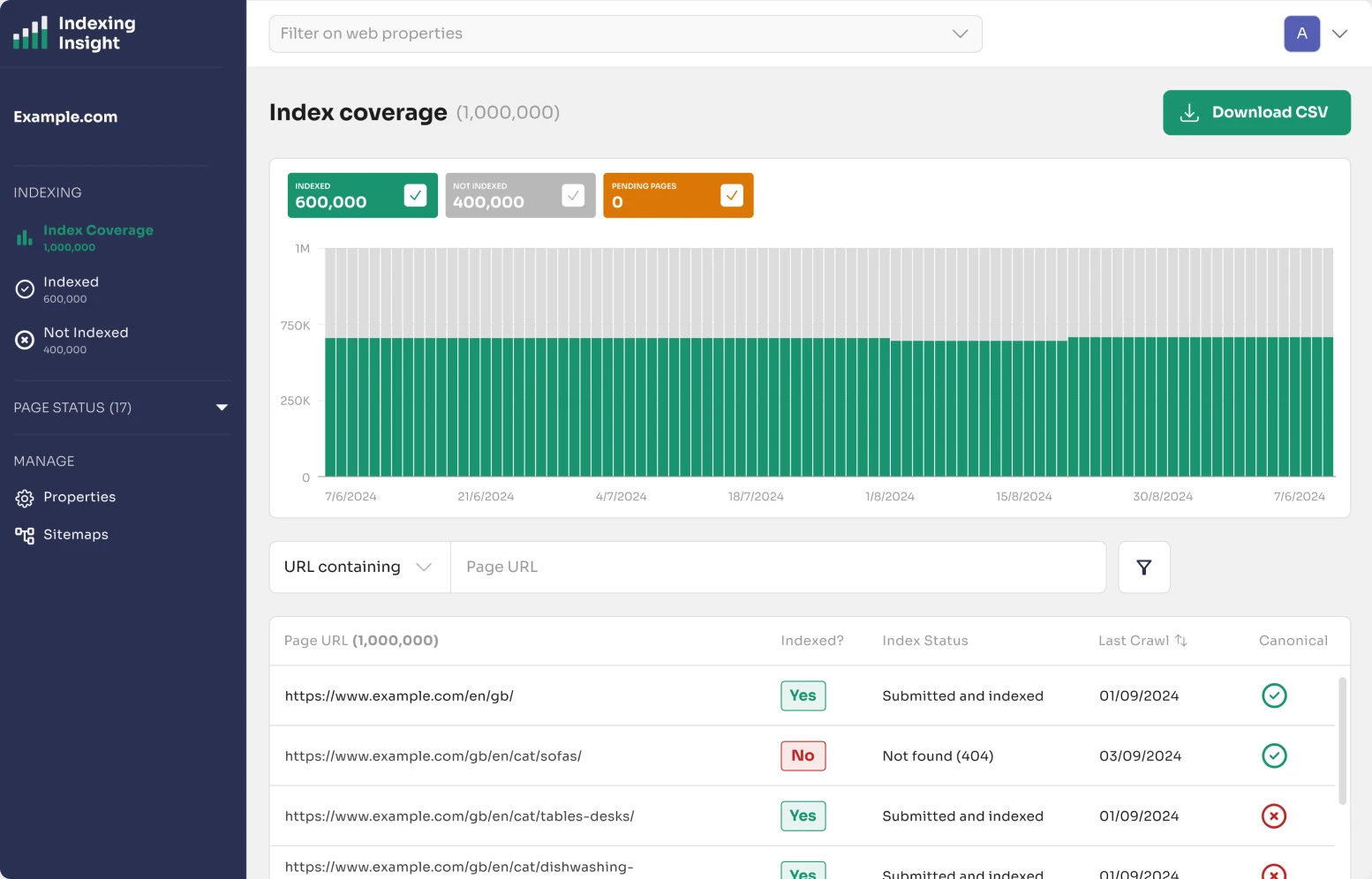

Indexing Insight, développé par Adam Gent, propose une analyse approfondie de l’**indexation**. Pour les gros sites, la limite de 2 000 URL/jour imposée par l’**API** standard devient rapidement insuffisante si l’on considère l’ensemble d’un sous-dossier.

En combinant une approche multi-propriété, il est possible d’exploiter ce plafond de manière additive — 2 000 URL par propriété devient un outil puissant si l’on fractionne correctement le site.

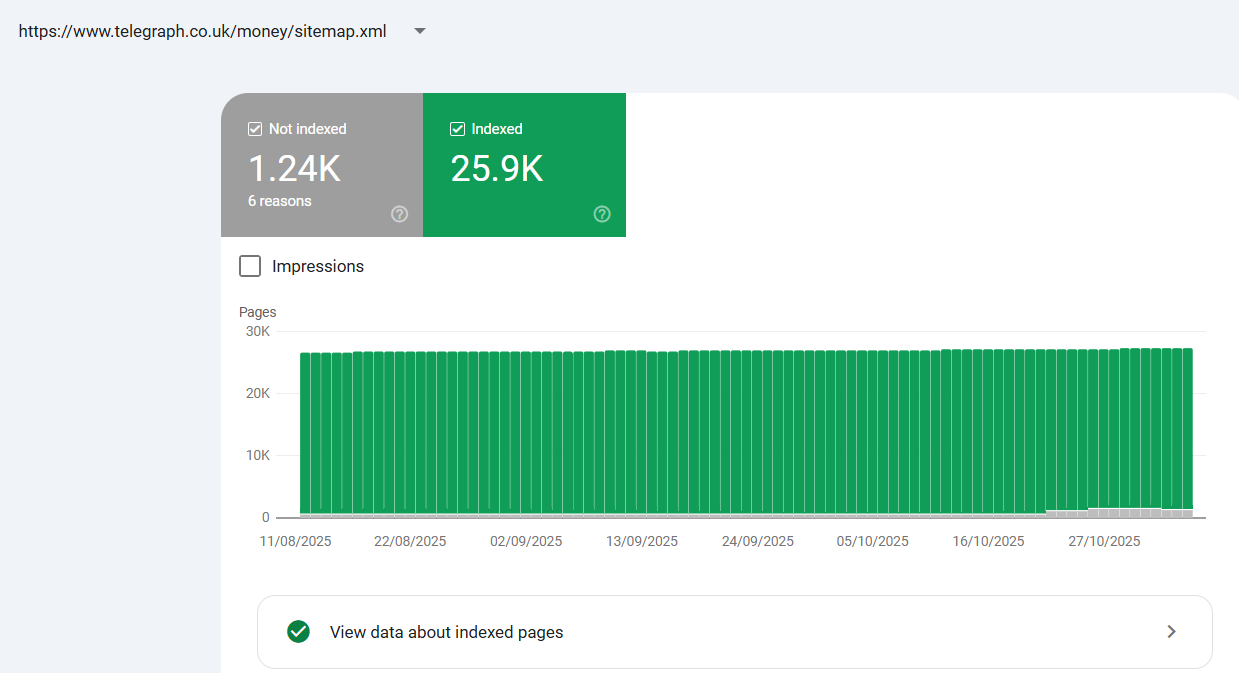

Éliminez les contraintes d’**indexation** liées aux 2 000 URLs/jour avec une approche multi-propriété (Image Credit: Harry Clarkson-Bennett)

Éliminez les contraintes d’**indexation** liées aux 2 000 URLs/jour avec une approche multi-propriété (Image Credit: Harry Clarkson-Bennett)Ces plateformes enrichissent instantanément l’expérience offerte par Search Console et offrent des visualisations souvent absentes de l’interface native.

Quels bénéfices apporte une stratégie multi-propriété ?

La technique la plus pragmatique pour contourner les limites précédemment exposées consiste à multiplier les propriétés dans Search Console. Deux raisons principales motivent cette approche : c’est gratuit et cela réduit l’impact des quotas API.

La gratuité plaît toujours. Pour illustrer : j’ai déjà fait la queue pour une offre gratuite improbable dans un kiosque — c’est dire à quel point « gratuit » motive parfois les comportements.

Plus sérieusement, fractionner un site volumineux en nombreuses propriétés apporte plusieurs gains concrets.

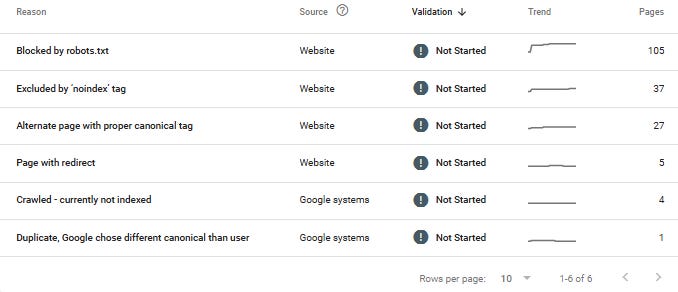

Suivi d’**indexation** plus fin

Un des atouts majeurs mais limités de Search Console est la capacité à analyser précisément l’**indexation** : distinguer le statut Crawled – Currently Not Indexed du statut Discovered – Currently Not Indexed aide à orienter les actions prioritaires.

Image Credit: Harry Clarkson-Bennett

Image Credit: Harry Clarkson-BennettLes pages classées Crawled – Currently Not Indexed ont été explorées mais, selon Google, ne présentent pas encore une qualité suffisante pour figurer dans l’index. Cela peut signaler des problèmes de qualité de contenu ou une priorisation inadéquate dans l’architecture des liens internes.

À l’inverse, les URLs marquées Discovered – Currently Not Indexed ont été détectées mais pas encore crawlées — situation qui peut découler de la cadence de publication, d’un maillage interne faible, ou d’un problème technique côté serveur.

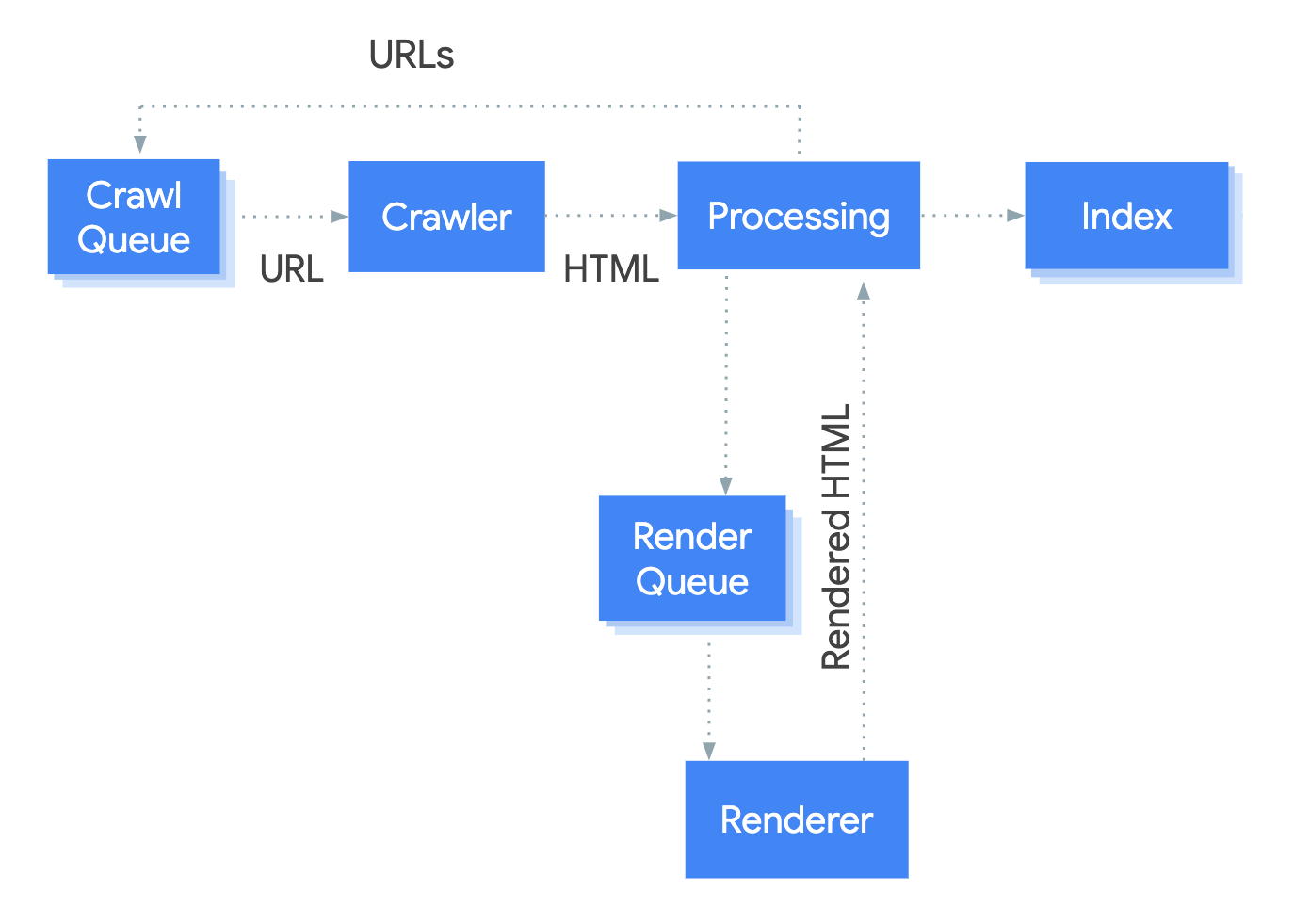

Comprendre ces distinctions nécessite une vue d’ensemble du pipeline d’**indexation** de Google. Ce n’est pas un processus binaire ; comme l’a expliqué Gary Illyes, Google utilise un système par « niveaux » pour stocker et servir le contenu. Les pages jugées plus critiques sont mises en avant dans des systèmes plus coûteux en ressources ; les pages moins prioritaires sont stockées dans des systèmes moins onéreux.

Schéma du fonctionnement du crawling et du rendu chez Google (Image Credit: Harry Clarkson-Bennett)

Schéma du fonctionnement du crawling et du rendu chez Google (Image Credit: Harry Clarkson-Bennett)Le rendu JavaScript, par exemple, est plus coûteux en ressources et peut être mis en file d’attente. D’où l’intérêt d’avoir un rendu côté serveur lorsque c’est possible pour accélérer l’**indexation**.

Adam Gent propose un guide utile sur les différents types de pages non indexées et leurs significations dans GSC.

Précision utile : l’outil d’inspection d’URL n’est pas instantané — il est mis à jour à intervalles réguliers (quelques fois par semaine selon les observations), et les états peuvent donc présenter un décalage. Chez les éditeurs d’actualité, beaucoup d’articles peuvent apparaître temporairement dans Crawled – Currently Not Indexed puis être visibles dans l’index après inspection manuelle.

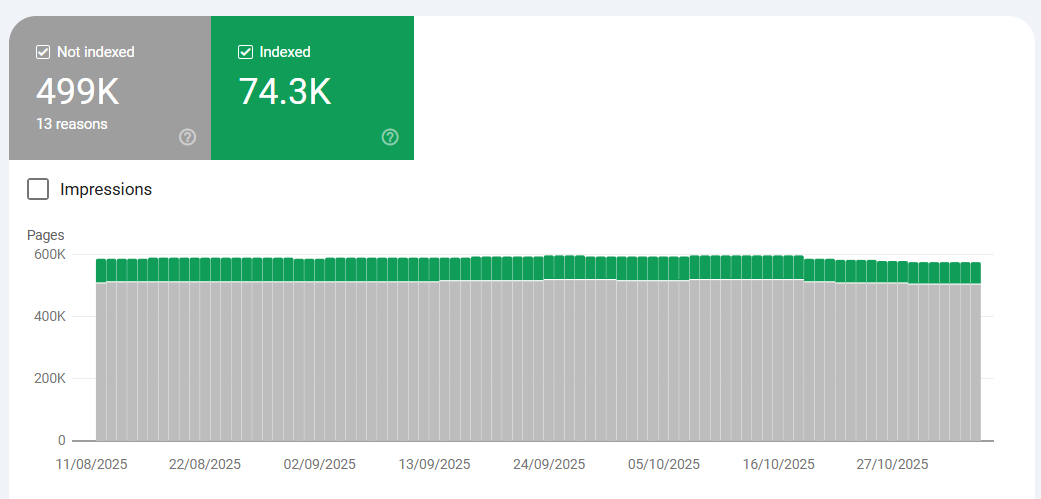

Scalabilité de l’**indexing API**

Sur des sites où un sous-dossier peut contenir plus de 500 000 pages, la limite de 2 000 URLs/jour imposée par l’**indexing API** devient vite un frein majeur si l’on cherche à surveiller les entrées et sorties de l’index au jour le jour.

Exemple d’un quota API insuffisant (Image Credit: Harry Clarkson-Bennett)

Exemple d’un quota API insuffisant (Image Credit: Harry Clarkson-Bennett)La solution pragmatique consiste à multiplier les propriétés : le plafond de 2 000 URLs est appliqué par propriété, donc en segmentant un site en plusieurs propriétés pertinentes (par sous-dossier, par catégorie, etc.), vous augmentez le volume d’URLs potentiellement interrogées chaque jour. Par exemple, une propriété de domaine plus 20 propriétés au niveau de sous-dossiers peut théoriquement permettre d’atteindre 42 000 requêtes d’URL/jour.

Quelques points à garder à l’esprit concernant l’**indexing API** :

- Elle permet de demander l’indexation d’URLs (ou de signaler des suppressions), mais n’offre aucune garantie d’indexation immédiate : c’est une requête, pas un ordre.

- La mise en place nécessite d’activer l’API dans la Google Cloud Console et de suivre le quickstart officiel — opération qui demande souvent du temps et des ajustements techniques.

- Un script (souvent en Python) pour orchestrer les requêtes, surveiller les quotas et analyser les codes de réponse (2xx, 3xx, 4xx, etc.) est recommandé pour bénéficier d’un suivi fiable.

En combinant ces requêtes avec vos données de publication, vous pouvez estimer les temps moyens d’indexation par section du site et déduire quelles zones Google juge prioritaires.

Données de clics et d’impressions plus détaillées

Pour les grands sites, le plafond de 1 000 lignes dans GSC est vite limitant, d’autant que l’historique accessible n’excède pas 16 mois. Pour des analyses annuelles ou pluriannuelles (par exemple, comparer des pics saisonniers YoY), il devient nécessaire d’exporter et de stocker ces données dans BigQuery ou un entrepôt similaire.

La méthode la plus simple pour obtenir davantage de granularité sans sortir complètement de l’écosystème Google est d’augmenter le nombre de propriétés : en fractionnant le site, vous disposez de plusieurs jeux de 1 000 lignes, ce qui atténue la contrainte et permet une exploration plus fine des requêtes et URLs.

Quel rôle jouent les sitemaps dans l’**indexation** ?

Les sitemaps ne sont pas un levier magique pour forcer l’indexation : l’aptitude d’une page à être indexée dépend surtout de sa valeur perçue pour l’utilisateur. Les sitemaps restent néanmoins utiles pour informer Google de la présence et de la fraîcheur d’URLs.

Les sitemaps pour l’actualité jouent un rôle spécifique : quand la vitesse d’indexation est critique, c’est une bonne pratique d’exposer clairement vos articles récents.

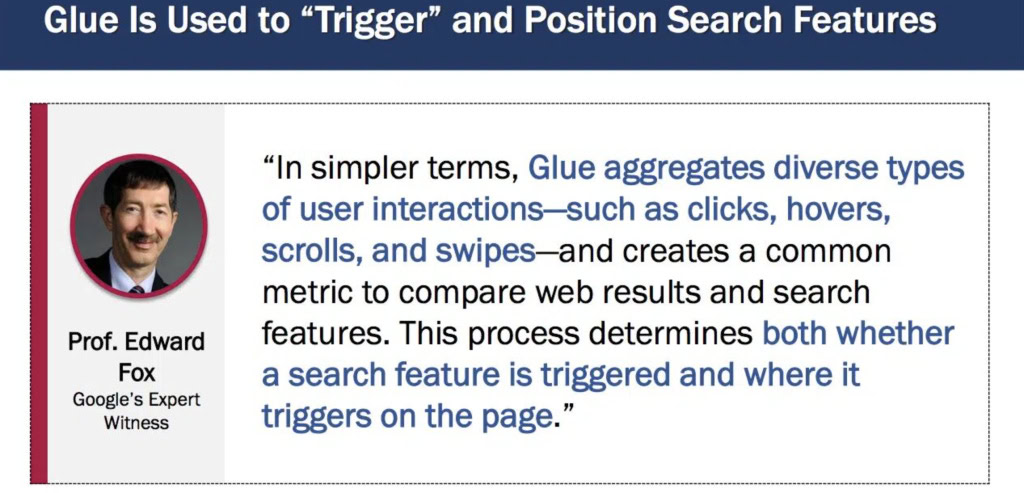

Au fond, l’indexation est conditionnée par le signal utilisateur : Google utilise des systèmes (comme le fameux « Glue » évoqué lors du procès DoJ et dans les fuites) pour mesurer l’engagement en temps réel (clics, survols, balayages) et décider de la dynamique de l’index.

Glue met en valeur des signaux d’interaction immédiats pour un retour d’information en quasi-temps réel (Image Credit: Harry Clarkson-Bennett)

Glue met en valeur des signaux d’interaction immédiats pour un retour d’information en quasi-temps réel (Image Credit: Harry Clarkson-Bennett)En résumé : avoir un sitemap correctement structuré et mis à jour aide Google à découvrir vos pages, mais la décision d’indexer repose sur la valeur et l’engagement autour de ces pages.

Et les index de sitemaps ?

Les gros sites gèrent souvent des index de sitemaps (sitemap of sitemaps) pour contourner la limite de 50 000 URL par document. Lors de l’envoi d’un index de sitemaps dans Search Console, il est conseillé d’uploader aussi chaque sitemap individuel présent dans cet index.

Cela permet d’avoir des métriques d’**indexation** au niveau de chaque sitemap via le rapport de page indexing, ce qui est beaucoup plus pratique lorsque l’on gère des millions de pages réparties dans de nombreux fichiers.

Des données au niveau du sitemap offrent une vue plus granulaires de l’**indexation** dans GSC (Image Credit: Harry Clarkson-Bennett)

Des données au niveau du sitemap offrent une vue plus granulaires de l’**indexation** dans GSC (Image Credit: Harry Clarkson-Bennett)Adoptez la même logique que pour les propriétés : plus vous segmentez de manière logique, plus vous obtenez de granularité dans les rapports.

Chaque document reçoit également un DocID. Ce DocID agrège des signaux — clics, qualité, autorité, données de crawl, score anti-spam — qui participent à l’évaluation et au classement des pages.

Les éléments considérés cruciaux pour le classement sont conservés et utilisés par les systèmes d’indexation et de ranking.

Quelles actions mettre en place maintenant ?

- Vérifiez votre configuration actuelle dans Search Console : exploite-t-elle suffisamment le potentiel des propriétés ?

- Disposez-vous d’une propriété au niveau du domaine et du rapport des crawl stats ?

- Avez-vous déjà fragmenté votre site en propriétés dans GSC ?

- Sinon, lancez un crawl pour définir quels sous-dossiers méritent d’être ajoutés comme propriétés.

- Révisez votre gestion des sitemaps : avez-vous uniquement un index de sitemaps ou avez-vous aussi importé chaque sitemap individuel dans GSC ?

- Envisagez de connecter vos exports à BigQuery pour conserver plus de 16 mois d’historique.

- Considérez l’activation de l’**API** (via Google Cloud Console) si vous avez besoin d’automatiser des demandes d’indexation.

- Étudiez les outils mentionnés plus haut pour compléter les données que Search Console ne fournit pas directement.

En définitive, Search Console reste un outil extrêmement utile mais contraint par des limites inhérentes — et il faut reconnaître que, pour être gratuit, il offre déjà beaucoup. L’objectif est donc d’en tirer le maximum : fractionner intelligemment vos propriétés, tirer parti des sitemaps et, si nécessaire, compléter par des solutions externes (analyse, stockage, API).

Ressources supplémentaires :

Ce billet a été initialement publié sur Leadership in SEO.

Image à la une : N Universe/Shutterstock

Articles connexes

- Pourquoi WooCommerce est lent et comment l’accélérer avec une pile serveur optimisée

- sortir de l’impasse sur l’efficacité en ligne

- Les différences de prix entre un freelance SEO et une agence SEO

- Google publie des recommandations sur les paywalls en JavaScript et le référencement

- Une vulnérabilité de WPBakery pour WordPress permet à des attaquants d’injecter du code malveillant

- goossips seo : concurrence entre pages et impact sur le nombre d’affichages – abondance

- Les 50 plateformes attirant le plus de visiteurs grâce à l’IA

- 5 stratégies SEO pour gagner visibilité et crédibilité dans les résultats de recherche alimentés par l’IA