Analyse : convaincre la direction d’investir dans la **recherche par IA** exige un changement de cadre — de la promesse de rendement certain à la garantie d’un apprentissage contrôlé.

Image Credit: Kevin Indig

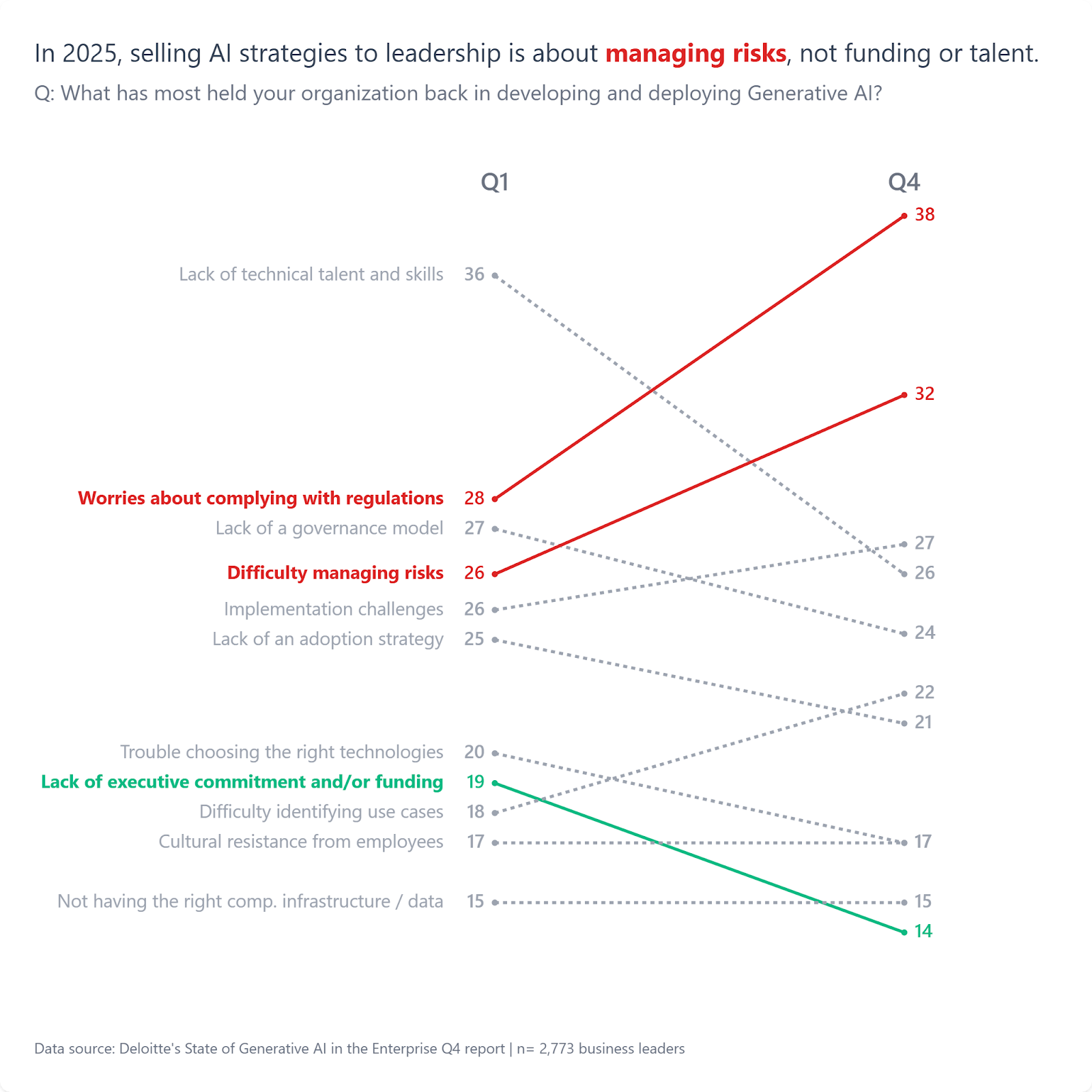

Image Credit: Kevin IndigUne enquête Deloitte auprès de plus de 2 700 dirigeants montre que l’obstacle majeur pour obtenir un budget dédié à la **stratégie de recherche par IA** n’est pas l’innovation, mais la perception du **risque**.

Les équipes **SEO** échouent souvent à convaincre la direction parce qu’elles vendent un **retour sur investissement déterministe** dans un contexte où les résultats sont intrinsèquement probabilistes.

Le modèle classique — positions → trafic → revenus — perd de sa pertinence face aux systèmes fondés sur des modèles de langage. Les **LLM** synthétisent des réponses ; ils ne “classent” pas de la même manière. De même, les fonctionnalités comme AI Overviews et AI Mode de Google ne “redirigent” pas forcément du trafic : elles répondent directement aux demandes.

Pour ces raisons, les équipes qui présentent encore des projections strictement basées sur les métriques SEO traditionnelles voient leurs propositions rejetées : la demande de garanties d’issue devient un obstacle plutôt qu’un argument. Dans l’écosystème de la **recherche par IA**, on ne vend pas la certitude d’un résultat — on vend la capacité à apprendre vite et à contrôler le risque.

1. Pourquoi on ne peut pas présenter la **recherche par IA** comme un ROI certain

La question que tout le monde pose est la mauvaise : « Comment prouver que ma **stratégie de recherche par IA** fonctionnera afin d’obtenir un budget ? » La réponse simple : on ne peut pas fournir la même chaîne causale qu’en SEO traditionnel. Les sorties des modèles comportent une part de variabilité et d’imprévisibilité qui rendent les prévisions précises caduques.

Obliger les décideurs à évaluer une démarche d’optimisation pour **LLM** avec un cadre issu du SEO classique crée deux problèmes principaux : incompréhension et attentes irréalistes. Les équipes SEO font face à plusieurs freins structurels lorsqu’elles tentent de défendre un plan d’action pour la **recherche par IA** :

- Attribution et ROI difficiles : Là où l’équipe voit une opportunité d’exposition, la direction voit des résultats flous et difficilement mesurables. Les réponses fournies par des plateformes comme ChatGPT, Perplexity ou des aperçus d’IA ne génèrent pas toujours des sources de trafic traçables.

- Désalignement avec les KPI business : Rattacher les efforts aux indicateurs financiers (CA, CAC, pipeline commercial) est souvent délicat, en particulier pour le B2B où le cycle de conversion est long.

- Perception d’expérimentation : Les dirigeants peuvent considérer les initiatives d’IA comme des paris, pas comme une stratégie opérationnelle, et les classer en priorités basses.

- Surfaces non détenues : Beaucoup de marques n’apparaissent pas du tout dans les réponses d’IA aujourd’hui. Les équipes vendent parfois une stratégie sans base initiale mesurable.

- Confusion conceptuelle : Direction et équipes mixtes confondent optimisation pour moteur de recherche traditionnel, optimisation pour **LLM**, et tactiques pour AI Overviews/AI Mode. Une clarification est nécessaire pour justifier un budget distinct.

- Préparation technique et éditoriale insuffisante : Sites web sans contenu structuré, autorité de marque limitée, ou documentation publique faible auront du mal à émerger dans les résultats synthétisés.

En résumé, la perception du risque provient souvent d’un déficit d’alignement méthodologique entre la manière dont les SEO mesurent le succès et la façon dont les dirigeants prennent des décisions.

2. Présenter la **stratégie de recherche par IA** comme une mesure d’atténuation du risque

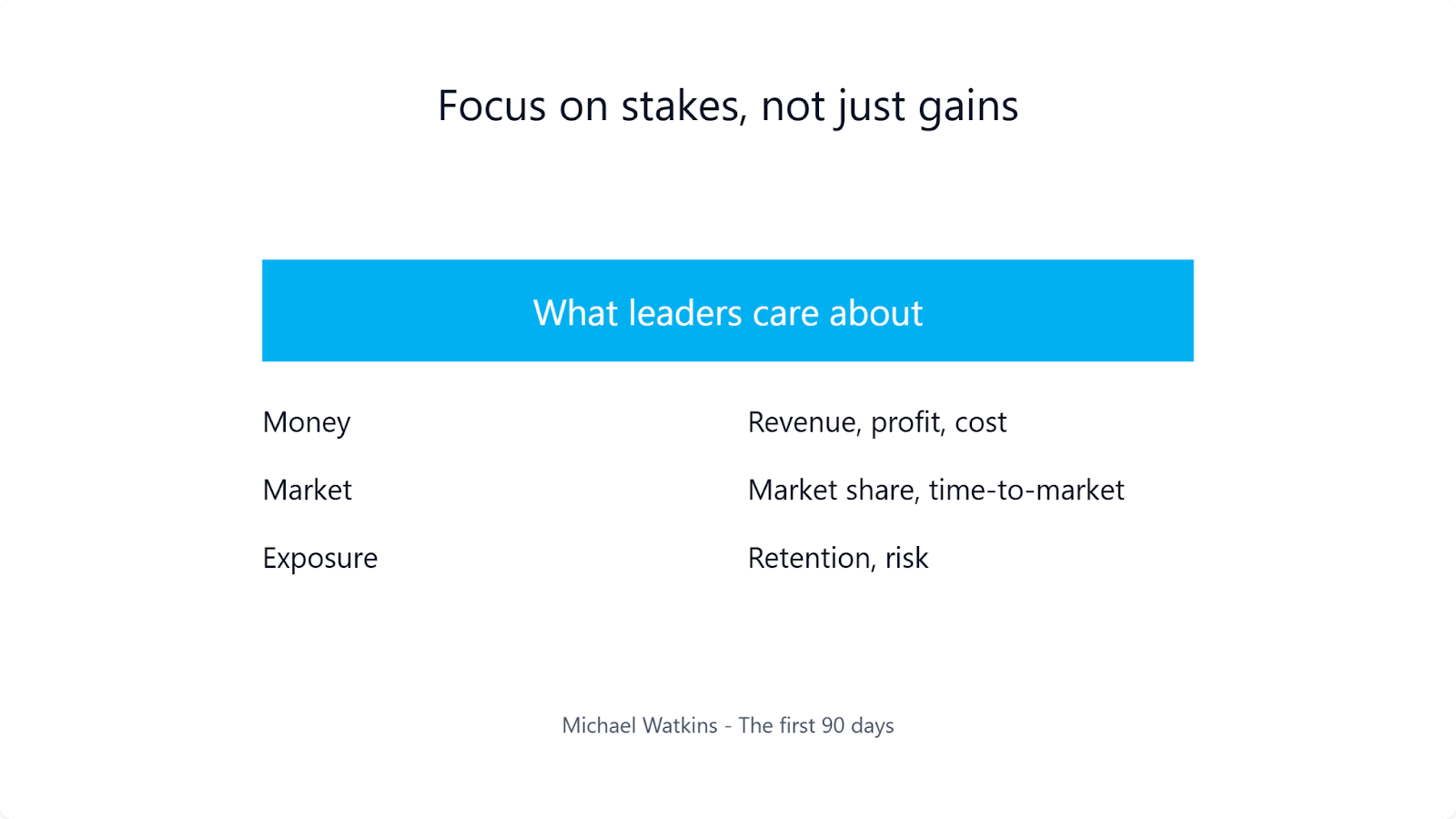

Les dirigeants n’achètent pas des promesses floues de performance dans des environnements ambigus : ils achètent une meilleure qualité de décision. La vraie question à poser est : faut-il investir maintenant pour apprendre et se positionner avant que des concurrents n’occupent l’espace, ou laisser la situation évoluer sans contrôle ?

Image Credit: Kevin Indig

Image Credit: Kevin IndigLa **recherche par IA** reste un territoire incertain. Il est préférable de structurer votre proposition autour d’un programme d’**apprentissage rapide et discipliné**, avec des critères d’arrêt prédéfinis, plutôt que de projeter du trafic et des conversions de façon imprécise. Au lieu de demander un « budget SEO supplémentaire », vous demandez à la direction de financer une option stratégique sur un canal de découverte émergent.

Formulez la proposition de façon que la question ne soit pas « Est-ce rentable ? » mais « Le coût de ne pas savoir est-il supérieur au coût de découvrir ? » Les dirigeants ne demandent pas une garantie d’impact ; ils exigent la garantie que leur investissement produira une décision argumentée et exploitable.

Clarifier les enjeux :

Votre point de vue + conséquences plausibles = enjeux. La direction a besoin d’une compréhension claire des conséquences en cas d’inaction.

Image Credit: Kevin Indig

Image Credit: Kevin IndigLes implications directes d’une absence d’action sont concrètes :

- Les concurrents qui investissent tôt en **recherche par IA** construiront une **autorité d’entité** et une présence de marque dans les réponses synthétiques.

- Le trafic organique pourrait stagner, puis décliner, tandis que le coût par clic augmente.

- Les **AI Overviews** et les sorties d’**AI Mode** remplaceront certaines requêtes que votre marque remportait auparavant sur Google classique.

- Votre influence sur le prochain canal de découverte se décidera sans votre participation active.

Une **stratégie de recherche par IA** vise à développer des signaux durables : autorité de marque, mentions tierces, relations d’entité, profondeur de contenu, et surfaces structurées. Ces signaux s’accumulent et peuvent même finir par alimenter les jeux de données d’entraînement des modèles futurs. Ne pas investir, c’est laisser la formation de ces empreintes aux acteurs qui s’y prennent tôt — et souvent en dehors de votre contrôle.

3. Proposez des expérimentations contrôlées : petites, réversibles, limitées dans le temps

Lorsque vous demandez des ressources, précisez que l’objectif est de découvrir une vérité opérationnelle avant que le marché n’impose sa solution par défaut. Cette approche réduit la résistance en supprimant la peur d’un coût irrécupérable et en transformant l’incertitude en étapes mesurables et réversibles.

Un pitch convaincant pour la **recherche par IA** ressemble à :

- « Nous réaliserons X expérimentations sur 12 mois. »

- « Budget : ≤ 0,3 % du budget marketing total. »

- « Trois étapes décisionnelles (gates) avec décisions Go/No‑Go. »

- « Plages de scénarios plutôt que prévisions faussement précises. »

- « Arrêt si les indicateurs avancés ne montrent pas d’évolution significative avant le T3. »

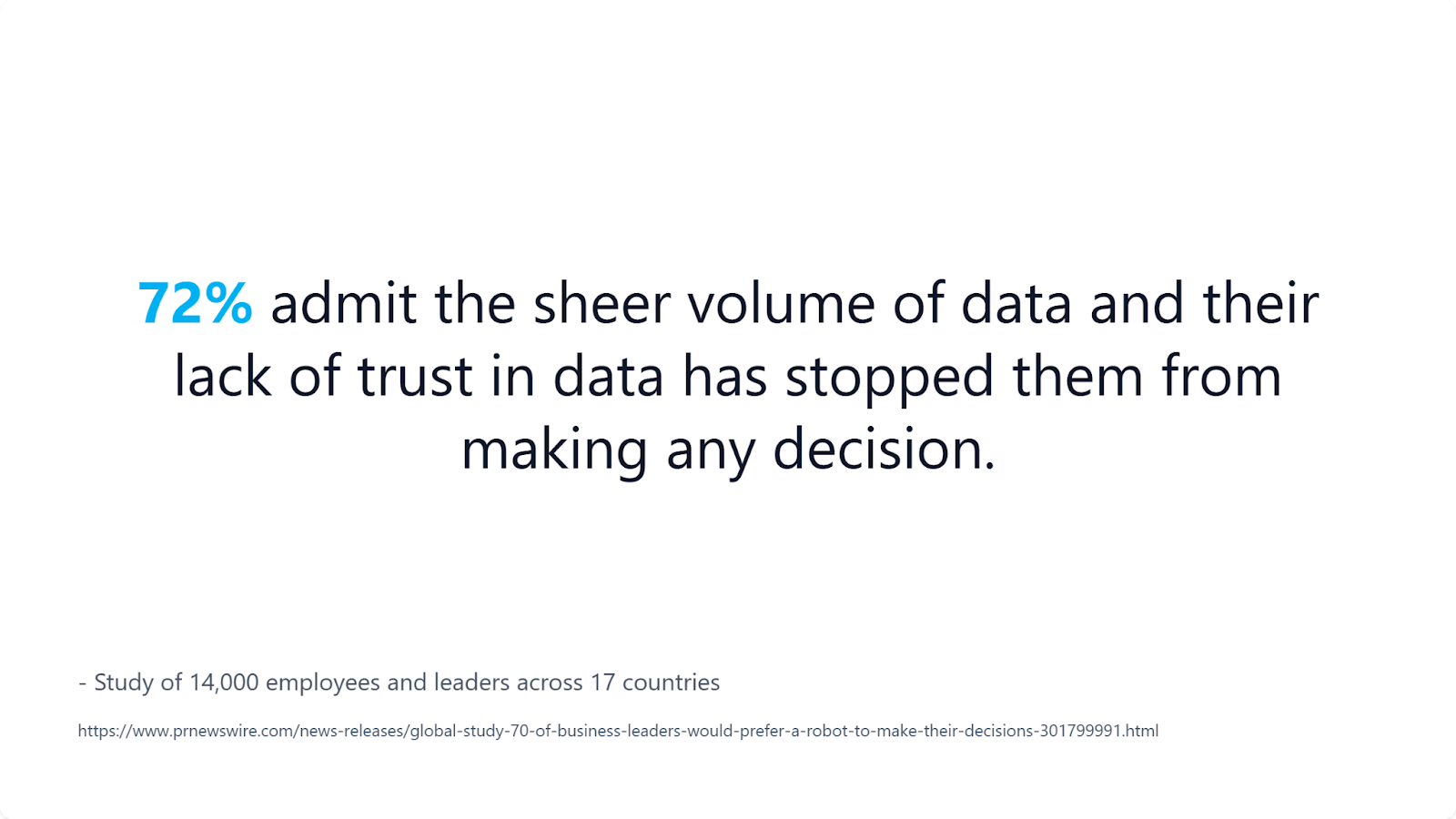

45 % des dirigeants se fient davantage à leur intuition qu’aux seuls faits. Pour convaincre, combinez des données avec un récit structuré : mettez l’accent sur les enjeux, les conséquences et la structure d’apprentissage, et non sur des détails techniques difficiles à traduire en valeur immédiate.

Je décris comment bâtir un deck et un récit stratégique dans un guide pour expliquer la valeur du SEO aux dirigeants, mais ici l’accent doit être mis sur la vente de l’**apprentissage** comme livrable dans le contexte de la **recherche par IA**.

Quand vous parlez aux décideurs, ils retiennent surtout trois éléments : l’argent (revenus, marge, coût), le marché (part de marché, vitesse de mise sur le marché) et l’exposition (risques, visibilité). Construisez chaque proposition autour de ces axes.

Utilisez la structure SCQA (Situation, Complication, Question, Réponse) :

- Situation : contextualisez le paysage actuel et vos forces.

- Complication : expliquez ce que la **recherche par IA** change et pourquoi le modèle actuel échoue.

- Question : que devons‑nous décider ?

- Réponse : proposez l’approche expérimentale avec budgets et critères d’arrêt clairs.

Cette méthode, inspirée de la pyramide de Minto, est familière aux dirigeants et favorise la prise de décision rapide et informée.

4. Quels types d’expérimentations lancer (exemples concrets)

Les expérimentations doivent tester des hypothèses précises et produire des indicateurs exploitables. Voici des tests typiques, structurés par objectif :

Construire de l’autorité d’entité et des mentions

- Campagne de publications ciblées sur des sites référents pour générer des mentions de marque et des relations d’entité.

- Création/optimisation de pages « hub » décrivant clairement l’entité (histoires, données publiques, FAQ) pour fournir au modèle des sources fiables.

- Suivi des mentions et de leur qualité via outils de monitoring d’entité.

Améliorer la structuration des contenus

- Ajouter des données structurées (schema.org, E-E-A-T markers) sur un segment pilote de pages à fort potentiel.

- Publier des documents techniques, guides, et références citables qui peuvent être extraits par les modèles.

- Tester des formats courts orientés “réponse” (FAQs, résumés, snippets) versus contenus longs pour observer la captation de réponses synthétiques.

Expérimentations de surfaces et de signaux

- Tester des micro‑pages répondant précisément à requêtes informationnelles courantes et mesurer les indicateurs de visibilité (mentions, snippets, position dans API SERP, etc.).

- Mettre en place un suivi des impressions/occurrences dans les résultats d’IA via scraping API, monitoring des réponses publiques et dashboards tiers.

Mesures d’engagement et de conversion

- Pour les cas où la réponse d’IA renvoie explicitement vers une page, instrumenter un tracking dédié (UTM, landing pages dédiées, événements JavaScript) afin de mesurer l’impact direct.

- Utiliser des métriques proxies : augmentation des recherches de marque, hausse des visites directes, mentions sociales de la marque corrélées au lancement des tests.

5. Définir des indicateurs avancés et des critères d’arrêt

En l’absence d’un chemin de conversion parfaitement traçable, concevez un tableau d’indicateurs avancés (leading indicators) et des critères d’arrêt clairs. Exemples :

- Indicateurs avancés : croissance des mentions d’entité de qualité (domaines à forte autorité), évolution des impressions dans les outils de monitoring de SERP IA, augmentation des recherches de marque et du taux de clics sur pages pilotes.

- Critères d’arrêt (kill criteria) : absence d’amélioration mesurable des indicateurs avancés après X mois, ROI cout‑opportunité dépassant le seuil défini, ou coûts opérationnels dépassant la limite supérieure convenue.

Un exemple concret : « Si, après six mois, les mentions d’entité provenant de domaines de DA ≥ 60 n’augmentent pas de 15 % et si les impressions d’IA sur les pages pilotes n’ont pas progressé de 20 %, nous arrêtons et réévaluons. »

6. Méthodes de suivi et d’attribution adaptées à la **recherche par IA**

Le suivi classique (clic → session → conversion) reste utile mais incomplet. Pour documenter l’impact de la **recherche par IA**, combinez plusieurs approches :

- Proxies quantitatifs : volume de mentions, recherches de marque, variations de trafic direct, et signaux de notoriété mesurés par outils d’audience et d’écoute média.

- Surveillance des réponses IA : requêtes types évaluées périodiquement dans des environnements contrôlés (API des moteurs, comptes tests) pour détecter des changements de sources citées.

- Expérimentations A/B : pages variantes avec et sans données structurées, ou avec formats de réponse différents, pour mesurer différences d’extraction et d’impact.

- Indicateurs qualitatifs : études d’opinion, panels utilisateurs et analyses de satisfaction client pour vérifier si les réponses d’IA influencent la perception de marque.

- Attribution croisée : combiner données CRM, analytics et signaux d’écosystème pour retrouver des corrélations plausibles entre exposition IA et pipeline commercial.

Ces mesures multiples permettent d’agréger de la preuve même quand le canal ne transmet pas directement le trafic mesurable dans l’outil d’analytics classique.

7. Gouvernance, équipe et outils recommandés

Pour conduire un programme d’expérimentation en **recherche par IA**, mettez en place une gouvernance légère mais effective :

- Comité de pilotage (CEO/CPO/CMO/Head of SEO) : décisions de Go/No-Go sur la base des critères d’arrêt.

- Équipe core : responsable SEO/IA, product manager, ingénieur contenu, spécialiste data/analytics, et un contact juridique si nécessaire (considérations de conformité et d’utilisation de données).

- Rituels : revues mensuelles des résultats, rapport de gouvernance trimestriel, et bilan à chaque gate.

- Outils : plateformes de monitoring d’entité (Brand monitoring), outils d’analyse de SERP/IA, solutions de data tagging, et pipelines analytics pour fusionner les sources.

La taille de l’équipe peut être modeste au départ ; l’important est la clarté des rôles et la rapidité d’exécution.

8. Exemples de budgets et calendriers plausibles

Voici deux scénarios-types pour dimensionner une expérimentation sur 12 mois :

Scénario conservateur (pilote)

- Durée : 6–12 mois

- Budget : 0,1–0,3 % du budget marketing annuel

- Ressources : 1 FTE SEO/IA, 0,5 FTE contenu, 0,5 FTE data/analytics

- Livrables : 10–20 pages pilotes optimisées, plan de mentions (PR/partenariats), dashboard de suivi

Scénario étendu (option stratégique)

- Durée : 12 mois

- Budget : 0,3–1,0 % du budget marketing annuel

- Ressources : petite équipe dédiée (2–4 FTE), support externalisé pour monitoring et extraction d’API

- Livrables : programme de contenu scaleable, campagnes d’acquisition de mentions, automatisation de la structuration des données, et pipeline d’analyses

Ces chiffres sont indicatifs ; l’objectif est de montrer que l’effort est mesurable, limité et proportionnel à l’enjeu stratégique.

9. Répondre aux objections courantes des dirigeants

Anticipez et préparez des réponses courtes et factuelles aux questions typiques :

- « On ne sait pas si ça va rapporter. » — Réplique : « Nous proposons d’acheter l’apprentissage : un programme contrôlé avec des critères d’arrêt et des milestones précis. »

- « Cela distraira l’équipe SEO. » — Réplique : « Le pilote utilisera un segment contrôlé et des ressources limitées ; l’objectif est d’augmenter la résilience du canal existant, pas de le remplacer. »

- « On ne voit pas comment mesurer. » — Réplique : « Nous mettrons en place des indicateurs avancés et des proxies complémentaires (mentions, impressions IA, recherches de marque) pour documenter l’impact. »

- « C’est trop risqué. » — Réplique : « Les biais de risque viennent d’un manque d’information ; notre proposition réduit le risque via des expérimentations réversibles et une gouvernance stricte. »

10. Structure d’un deck pour la direction (résumé exécutoire)

Un deck efficace doit tenir sur quelques diapositives claires :

- Contexte et position actuelle (situation) — 1 diapo

- Complication : ce que change la **recherche par IA** — 1 diapo

- Enjeux si on n’agit pas (conséquences) — 1 diapo

- Proposition : programme d’expérimentations, budget, calendrier — 1 à 2 diapos

- Métriques et critères d’arrêt — 1 diapo

- Ressources et gouvernance — 1 diapo

- Scénarios (conservateur/étendu) et options — 1 diapo

La règle est de rester synthétique et orienté décision : la direction veut savoir combien, combien de temps, et quel risque contrôlé elle prend.

11. Mesurer l’apprentissage : reporting et itérations

Le cœur du programme est la capacité à transformer chaque expérimentation en apprentissage actionnable. Définissez des rapports périodiques (mensuels) et des revues à chaque gate :

- Rapport mensuel : état d’avancement des indicateurs avancés, nouvelles mentions, résultats de tests A/B, surprises & hypothèses mises à jour.

- Revues de gate : récapitulatif des données, décision Go/No‑Go, ajustements de la méthodologie.

- Post-mortem en cas d’arrêt : ce qui a été appris, pourquoi cela n’a pas marché, et quelles compétences/processus restent utiles.

Cet apprentissage capitalisable permettra d’industrialiser les tactiques efficaces ou de pivoter rapidement si le signal n’apparaît pas.

12. Conclusion : vendre la capacité à décider, pas la promesse d’un résultat

Dans l’univers des modèles linguistiques et des réponses synthétiques, il est déraisonnable de demander aux dirigeants d’acheter une promesse de rendement certain. Ils sont prêts à investir si vous leur vendez une méthode structurée pour réduire l’incertitude : un programme d’expérimentations limité, mesurable, et muni de critères d’arrêt clairs.

La clé pour obtenir l’adhésion est de recentrer le discours : remplacer la promesse d’un ROI déterministe par la vente d’un cadre d’**apprentissage contrôlé**. Montrez les enjeux d’inaction, proposez des tests réversibles, mesurez avec des indicateurs avancés et présélectionnez des critères d’arrêt. Ce cadre réduit le risque perçu et aligne le projet sur les préoccupations financières et stratégiques des dirigeants.

Featured Image: Paulo Bobita/Search Engine Journal

Articles connexes

- Dissiper la méfiance à l’égard des campagnes de mentions de marque et de création de liens

- Automattic conteste l’emploi du terme « Automatic » pour un produit WordPress

- comment maîtriser le référencement naturel (SEO) ?

- Google clarifie sa position sur la cannibalisation des mots-clés en SEO

- Comet, le navigateur d’intelligence artificielle de Perplexity est désormais disponible pour tout le monde

- les allégations juridiques d’automattic sur le référencement : est-ce fondé ?

- Google ajoute des capacités d’agents à l’AI Mode et étend son accès à l’échelle mondiale

- Google intègre NotebookLM à ses mécanismes de récupération à la demande des utilisateurs