En marketing, nous aimons les entonnoirs clairs : ils montrent où se situent les prospects, permettent de calculer des taux de conversion et d’observer le parcours client depuis la découverte jusqu’à l’achat. Pourtant, dans un univers dominé par l’**IA**, cet entonnoir devient de plus en plus opaque.

Il est aujourd’hui difficile de mesurer pleinement la visibilité au sein d’expériences conversationnelles comme ChatGPT ou Perplexity. Des outils émergents fournissent des indices partiels, mais leurs données sont loin d’être exhaustives et manquent souvent de constance. Les indicateurs traditionnels — impressions, clics, position moyenne — ne rendent pas compte de ce qui se passe quand une requête est traitée par un agent conversationnel ou un résumé généré par une IA, créant ainsi un nouveau goulet d’étranglement pour les analystes.

Pour mieux y voir, examinons ce que nous pouvons réellement mesurer concernant les données structurées (parfois appelées balisage Schema), et ce qui demeure hors de portée pour l’instant. Comprendre ces deux aspects nous aide à concentrer nos efforts sur ce qui est contrôlable aujourd’hui et à repérer les opportunités offertes par la transformation des mécanismes de découverte.

Pourquoi beaucoup de métriques dites de « visibilité IA » sont trompeuses

L’arrivée de l’**IA** a déclenché une soif de nouveaux indicateurs. Face à l’impossibilité de mesurer directement certaines interactions, beaucoup de fournisseurs créent des métriques inédites — par exemple la « notoriété de marque sur les plateformes IA » — qui reposent sur des jeux de données non représentatifs.

Certaines solutions tentent de quantifier les « prompts IA » en traitant de courts ensembles de mots-clés comme s’il s’agissait des requêtes réelles soumises par des utilisateurs à ChatGPT ou Perplexity. Cette méthode est trompeuse : les utilisateurs formulent le plus souvent des instructions longues, riches en contexte et personnalisées. Ces prompts sont conversationnels, nuancés et fortement contextualisés — loin des requêtes courtes que l’on analyse traditionnellement.

Ces indicateurs artificiels donnent une impression de contrôle qui peut être illusoire et détourner l’attention des leviers réellement mesurables. En réalité, des services comme ChatGPT, Perplexity et même les résumés générés par Google ne fournissent pas, à ce jour, une visibilité claire et complète sur la manière dont une marque est utilisée ou citée dans les réponses.

Alors, que peut-on mesurer de manière fiable et qui influence vraiment la visibilité ? Les données structurées.

Qu’entend-on par « visibilité dans la recherche IA » ?

Avant d’aborder les indicateurs, définissons ce que signifie la « visibilité IA ». En SEO traditionnel, être visible équivalait à apparaître en première page ou à générer des clics. Dans un contexte façonné par l’**IA**, être visible revient à être compris, jugé fiable et cité par les moteurs et les systèmes d’IA. Les données structurées participent à cette mutation : elles formalisent, relient et clarifient les entités digitales d’une marque afin que les moteurs et agents puissent les interpréter correctement.

Ce que nous savons : mesures fiables autour des données structurées

Voyons maintenant ce qui est mesurable aujourd’hui avec un degré élevé de confiance concernant les données structurées.

Augmentation du taux de clics grâce aux résultats enrichis

L’implémentation de données structurées sur des pages peut rendre ces pages éligibles à des **résultats enrichis** (rich results) et, dans bien des cas, augmenter leur taux de clic organique. Google prend en charge plusieurs dizaines de types de résultats enrichis, qui continuent d’apparaître dans les pages de résultats organiques.

Par exemple, selon nos analyses internes, au troisième trimestre 2025, un acteur majeur du secteur des appareils électroménagers a observé une hausse de l’ordre de 300 % du taux de clics sur des pages produits lorsque celles-ci ont obtenu un résultat enrichi. Les rich results restent un levier réel — mesurable et reproductible — pour améliorer à la fois la visibilité et la conversion depuis le trafic organique.

Example of a product rich result on Google’s search engine results page (Screenshot by author, November 2025)

Example of a product rich result on Google’s search engine results page (Screenshot by author, November 2025)Hausse des clics non-marqués grâce à une liaison d’entités robuste

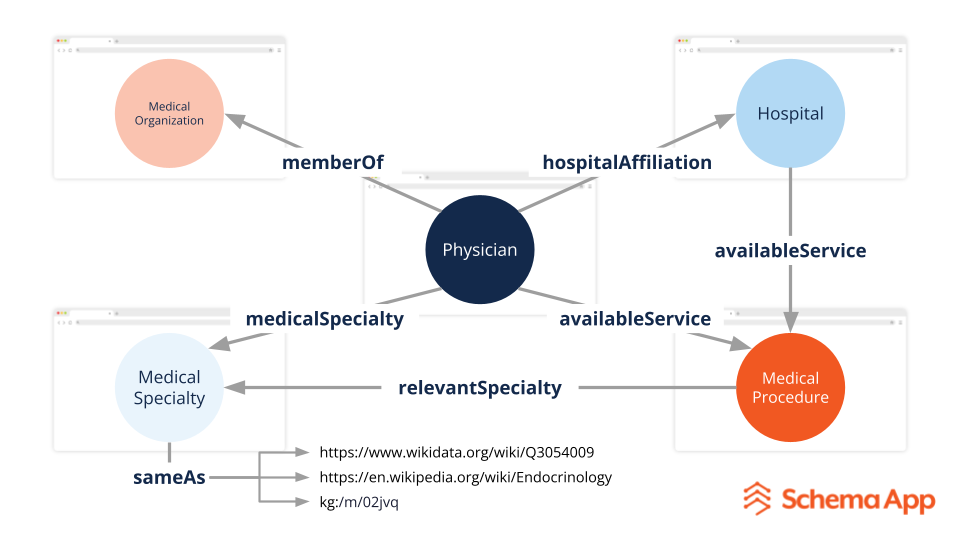

Il est utile de distinguer un balisage Schema basique d’un balisage sémantique riche qui inclut de la liaison d’entités et qui alimente un véritable graphe de connaissances. Le balisage décrit ce qui figure sur une page ; la liaison d’entités relie ces éléments à d’autres entités clairement définies sur votre site ou sur le web, établissant des relations qui donnent du sens au contenu.

Une entité est un objet ou un concept identifiable (une personne, un produit, un service). La liaison d’entités documente les relations entre ces éléments, soit via des sources externes reconnues (Wikidata, le graphe de connaissances de Google), soit grâce à un graphe de connaissances interne propre à l’entreprise.

Par exemple, une page présentant un médecin peut comporter un balisage qui décrit le praticien. Un balisage sémantique avancé liera ce médecin à sa spécialité via Wikidata, à l’établissement hospitalier concerné et aux services proposés, ce qui facilite pour les systèmes externes de comprendre le contexte et la fiabilité de l’information.

Image from author, November 2025

Image from author, November 2025Visibilité dans les AI Overviews (AIO)

Les indicateurs SEO traditionnels ne captent pas encore toutes les interactions dans les environnements IA, mais certains outils peuvent détecter des mentions de marques lorsque celles-ci apparaissent dans un AIO (AI Overview) ou dans des réponses générées par l’IA.

Un rapport de BrightEdge a montré que des pratiques SEO basées sur les entités favorisent une meilleure visibilité dans ces réponses alimentées par IA. Le rapport soulignait :

« L’IA privilégie le contenu provenant d’entités connues et fiables. Plutôt que d’optimiser pour des mots-clés fragmentés, construisez une autorité thématique approfondie. Nos données indiquent que le contenu provenant d’entités faisant autorité est trois fois plus susceptible d’être cité par des réponses IA que des pages trop ciblées. »

Ce que nous ne pouvons pas (encore) mesurer précisément

Si l’on peut évaluer l’impact des entités intégrées via le balisage Schema avec des métriques SEO classiques, nous n’avons pas encore d’accès direct et exhaustif à la façon dont ces éléments influencent le comportement interne des grands modèles de langage (LLM).

Comment les LLM exploitent les données structurées

La visibilité commence par la compréhension — et la compréhension repose en partie sur les données structurées.

Les signaux s’accumulent : dans un billet daté du 8 octobre 2025, Microsoft expliquait dans « Optimizing Your Content for Inclusion in AI Search Answers (Microsoft Advertising) » que l’un des défis pour les marketeurs est de rendre leur contenu facilement compréhensible et structuré pour qu’il soit utilisable par les systèmes d’IA. Krishna Madhaven, Principal Product Manager chez Microsoft Bing, a résumé :

« Pour les marketeurs, la difficulté consiste à formuler un contenu compréhensible et organisé de manière à ce que les systèmes d’IA puissent l’exploiter. »

Il ajoutait encore :

« Le schema est un type de code qui aide les moteurs de recherche et les systèmes d’IA à comprendre votre contenu. »

De la même façon, un article de Google intitulé « Top ways to ensure your content performs well in Google’s AI experiences on Search » rappelle que les données structurées sont utiles pour fournir des informations lisibles par machine au sujet de votre contenu.

Pourquoi ces efforts de la part de Google et Microsoft ? La raison est en partie économique et pratique : les données structurées facilitent la construction de graphes de connaissances, qui sont des fondations efficaces pour des systèmes IA plus précis, explicables et fiables. Des recherches montrent que les graphes de connaissances permettent de réduire les « hallucinations » et d’améliorer les performances des LLM.

Même si le balisage Schema n’est pas directement utilisé comme données d’entraînement massives pour un modèle, il intervient dans les phases de récupération d’information (retrieval) dans des architectures de type RAG (retrieval-augmented generation). Par exemple, le système GraphRAG de Microsoft génère un graphe de connaissances à partir de textes (extraction d’entités et de relations) et intègre ce graphe dans son pipeline de recherche. Dans leurs expériences, GraphRAG surpasse souvent une approche RAG de base, surtout sur des tâches demandant un raisonnement multi-étapes ou une mise en contexte entre entités distinctes.

Cela explique pourquoi les grands acteurs invitent les entreprises à investir dans des données structurées : elles jouent un rôle d’« armature » permettant aux systèmes de retrouver et de contextualiser des informations précises.

Au-delà du SEO page par page : concevoir un graphe de connaissances

Il existe une différence fondamentale entre optimiser la SEO d’une page isolée et créer un graphe de connaissances qui relie l’ensemble du contenu et des entités d’une organisation. Lors d’une interview, Robby Stein, VP Produit chez Google, a expliqué que les requêtes alimentées par l’IA peuvent impliquer des dizaines de sous-requêtes en parallèle (un phénomène appelé query fan-out). Ce niveau de complexité impose une approche globale.

Pour performer dans ce contexte, il ne suffit plus d’optimiser des pages : il faut construire une couche de données représentant le contexte métier complet — un graphe de connaissances ou une couche sémantique reliant produits, ressources, auteurs, services et entités externes.

Les étapes concrètes comprennent :

- Cartographier les entités clés de l’entreprise (produits, personnes, services, lieux).

- Normaliser les identifiants et les référentiels (utiliser des URI stables, des correspondances Wikidata, etc.).

- Publier des données structurées cohérentes et liées sur l’ensemble du site.

- Construire ou intégrer un graphe de connaissances interne et alimenter les liens de confiance vers des sources externes reconnues.

- Surveiller les signaux (mentions, citations dans des AI Overviews, performances des rich results) et ajuster la taxonomie et le balisage.

La vision du Web sémantique, en train de se réaliser

Ce qui devient tangible aujourd’hui, c’est la réalisation progressive du rêve du Web sémantique. Dans leur article « The Semantic Web » (Scientific American, 2001), Tim Berners‑Lee, Ora Lassila et James Hendler écrivaient :

« Le Web sémantique permettra aux machines de comprendre des documents et des données sémantiques, et permettra à des agents logiciels de parcourir des pages pour exécuter des tâches sophistiquées pour les utilisateurs. »

Nous observons cette transformation : des transactions et des recherches se déroulent directement à l’intérieur d’agents de type ChatGPT, et des initiatives comme NLWeb (annoncée par RV Guha, créateur de Schema.org) visent à rapprocher les sites web et les interfaces conversationnelles. NLWeb se définit comme une façon rapide et simple de transformer un site en application IA, permettant d’interroger son contenu en langage naturel comme avec un assistant.

Dans une discussion avec RV Guha, il a expliqué que NLWeb ambitionne d’être le point d’entrée pour des agents interagissant avec des sites web et qu’il s’appuie notamment sur des formats semi-structurés tels que Schema.org pour construire des interfaces en langage naturel utilisables par les humains et par les agents IA.

« NLWeb exploite des formats semi-structurés comme Schema.org… pour créer des interfaces en langage naturel utilisables tant par les personnes que par les agents. »

Transformer l’entonnoir sombre en entonnoir intelligent

Ainsi que nous l’avons souligné, il manque aujourd’hui des métriques exhaustives pour mesurer la performance d’une marque dans des environnements comme ChatGPT ou Perplexity. De la même manière, nous ne disposons pas encore d’indicateurs complets quant au rôle exact du balisage Schema dans la visibilité au sein des IA. Néanmoins, des signaux constants émanant de Google et de Microsoft indiquent que les données structurées sont utilisées, au moins partiellement, par leurs expériences IA pour comprendre et retrouver du contenu.

La réussite future des marques dépendra de leur capacité à être à la fois comprises et jugées dignes de confiance par des machines. Les données structurées constituent un élément parmi d’autres pour atteindre cet objectif : elles facilitent l’intégration dans des graphes de connaissances, permettent une meilleure qualification des contenus et réduisent le risque d’être absent des réponses générées par l’IA.

Au niveau opérationnel, voici quelques recommandations mesurables et neutres pour progresser dès aujourd’hui :

- Prioriser le balisage des pages à fort volume ou à fort potentiel de conversion (fiches produits, pages services, biographies clés).

- Vérifier régulièrement l’éligibilité aux rich results via la Search Console de Google et corriger les erreurs de balisage identifiées.

- Élargir le balisage pour inclure des identifiants et des relations (création de liens vers des entités externes comme Wikidata).

- Documenter un référentiel d’entités interne et assigner des URI stables afin d’alimenter un graphe de connaissances d’entreprise.

- Mesurer les gains observables : CTR, impressions sur types de SERP enrichis, trafic non-brand, et mentions détectées dans des AIO ou rapports spécialisés.

Conclusion : enjeux pratiques et limites actuelles

La révolution IA modifie la manière dont le trafic se forme et comment les utilisateurs reçoivent des réponses. Nous ne disposons pas encore d’un tableau de bord idéal permettant de suivre chaque citation d’une marque au sein d’une réponse d’IA, mais nous pouvons consolider des leviers tangibles. Les données structurées, la liaison d’entités et la construction d’un graphe de connaissances fournissent des points d’ancrage concrets et mesurables pour améliorer la compréhension et l’utilisabilité de votre contenu par les systèmes automatisés.

Les acteurs technologiques majeurs encouragent aujourd’hui les bonnes pratiques sémantiques parce qu’elles servent l’efficacité des modèles et rendent les réponses plus justifiables. La route vers une visibilité IA pleinement traçable est encore longue, mais en investissant dans une architecture sémantique et des données structurées de qualité, les entreprises peuvent réduire l’incertitude et gagner en résilience face à l’évolution des modes de recherche.

More Resources:

Featured Image: Roman Samborskyi/Shutterstock

Articles connexes

- les sites localisés enregistrent une visibilité supérieure de 327 % dans les synthèses générées par l’intelligence artificielle

- Ce que les agences doivent maîtriser pour accompagner des clients en référencement local

- google déconseille de se baser sur les scores fournis par les outils d’audit SEO

- Comment gagner la confiance de Google pour les contenus sensibles ?